1 Visión general de la informática

¿Qué es un ordenador?, partes que lo integran

21 marzo 2004 |

Consideraciones previas

En sentido ordinario el término información está ligado al de adquisición de conocimientos, así se dice haber recibido información cuando se conoce algo que se ignoraba o se había olvidado. Pero la informática como cualquier otra disciplina científica necesita de conceptos objetivos y la noción anterior es muy subjetiva. La informática trata de la adquisición, representación, tratamiento y transmisión de la información.

Se puede afirmar que el ordenador no es un dispositivo más de los que ha creado el hombre, sino que es una herramienta que afecta a nuestra forma de pensar, de actuar, a nuestras pautas de conocimiento y desarrollo social. La informática ejerce un profundo efecto social y tecnológico. El influjo que tiene en la sociedad es palpable en una gran cantidad de actividades humanas.

Los primeros ordenadores aparecieron ante la necesidad de realizar grandes cálculos, en aplicaciones militares, que escapaban a las posibilidades humanas. No obstante se observó que estas máquinas podían ayudar a resolver problemas en otras áreas de la actividad humana, que van desde la artística a las puramente científicas.

Una de las principales ventajas de los ordenadores es la rapidez. El tiempo de operación de un ordenador para operaciones simples es del orden de nanosegundos (1 ns= 10-9 segundos). Para tener una idea del orden de magnitud, si suponemos una operación de suma que el ordenador tarda 1 ns en ejecutarla y un humano tarda 1 s, en una operación que el ordenador la ejecutara en 1 s, una persona tardaría 31.5 años.

La fiabilidad es otra ventaja del ordenador frente a la operación humana. La mayoría de las veces los errores que se producen al trabajar con un equipo informático, son de índole

humana, bien por errores al proporcionarle los datos, o de programación.

La capacidad de los dispositivos de almacenamiento actuales (magnéticos y ópticos) es muy superior a cualquier medio de los disponibles previamente.

En cuanto al precio, que hasta no hace mucho tiempo, era un impedimento para la difusión de los ordenadores, ha bajado de forma vertiginosa conforme se han ido abaratando los procesos de fabricación de los componentes electrónicos de que constan.

Dada la amplia difusión de la informática, se ha incorporado en los currícula de muchas universidades, enseñanzas relacionadas con el uso de los ordenadores, en todo tipo de estudios, aunque no tengan relación directa con la informática.

La gran empresa y los organismos oficiales son unos de las grandes consumidoras de productos informáticos. Del ordenador se están aprovechando una serie de cualidades como pueden ser su

eficacia, el abaratamiento de costes en el tratamiento de la información, la seguridad o el acortamiento en la gestión de datos, y recientemente su facilidad de conexión mediante Internet, de tal forma que lo convierten en una herramienta imprescindible. Pero quizás las cualidades más importantes sean su capacidad de mejorar la calidad y la velocidad en el flujo de los datos.

La informática es un conjunto de conocimientos científicos y técnicos que se ocupan del tratamiento automático de información por ordenadores. La informática o ciencia de los ordenadores aparece como un intento de estructurar todos los avances tecnológicos y de programación que se producen vertiginosamente. La informática posee una rama teórica que le da carácter de ciencia y otra de diseño que junto con la experimental le da carácter de

ingeniería.

Se distinguen diversas ramas de conocimiento dentro de la informática como:

-

Arquitectura de ordenadores.

-

Lenguajes de programación.

-

Algoritmos y estructuras de datos.

-

Metodología de la programación. Ingeniería del software.

-

Análisis y desarrollo de sistemas informáticos.

-

Robótica

-

Inteligencia artificial.

-

Informática gráfica.

-

Informática Industrial.

Con esta introducción se ha intentado reflexionar

acerca de la influencia social que supone la aparición de la informática

y de la necesidad de tener unos ciertos conocimientos informáticos.

Algunas consideraciones generales

Informática es una palabra formada por la

contracción de dos vocablos, INFORmación

y autoMÁTICA. La informática

puede definirse como la ciencia que estudia el tratamiento racional de

la información por medio de máquinas automáticas.

El término información hace referencia a la yuxtaposición de símbolos, con los que se representan convencionalmente hechos, objetos o ideas.

La palabra información viene del latín "informatio", que significa iluminación, cuerpo

de conocimientos, interpretación, diseño, descubrimiento,... El estudio moderno

de la información comenzó cuando los científicos iniciaron la aplicación de la teoría de probabilidades al análisis de los canales de comunicación. Este estudio fue iniciado por Claude Shannon (1916-2001), que en aquella época era investigador de la "Bell Telephon Company", siendo muy sencillo el núcleo de esta teoría.

Si un mensaje x está compuesto de un número arbitrario de símbolos, x1, x2, ...xn, tomados de un alfabeto de N símbolos diferentes, el contenido de información o la "entropía del mensaje" está dado por la siguiente fórmula:

H(x)= -S

p(i) Log2 p(i) (Con el sumatorio de i=1 hasta N)

donde p(i) es la frecuencia relativa o probabilidad

de encontrar el símbolo xi en x.

Esta teoría de la información es algo

limitada y asume deliberadamente ergodicidad (por ejemplo, homogeneidad

estadística) del proceso y considera que se puede dar la elección

previa de todos los mensajes que se envían. En otras palabras, se

supone que la distribución de probabilidad no cambia en el tiempo

o a través de subconjuntos de mensajes del conjunto. Además

el lenguaje no puede cambiar y se debe conocer previamente.

Al poco tiempo, en 1952, fue criticada por no tratar estadísticamente

ciertas propiedades de los mensajes.

En principio había muchas razones para el

poco éxito de esta teoría, nació como una fórmula

matemática y la ampliación de esta teoría llegó

con el cambio de significado de "información". Una primera etapa

fue cambiar el campo de acción de esta teoría de una medida

estadística de mensajes, a una característica de cualquier

tipo de eventos interconectados. Cualquier secuencia de símbolos

se considera como un mensaje. Últimamente, cualquier resultado de

una medida se puede leer como un símbolo y por lo tanto concerniente

con la teoría de la información. "Esto es, si una transmisión

de mensajes tiene lugar en el sistema y el observador. Entonces el contenido

de información del sistema es de hecho la cantidad de información

transmitida en este canal"

El prototipo de un sistema que trate información

de este tipo, está claro que es un ordenador. Un ordenador se caracteriza

por el hecho curioso de que en el ámbito de comportamiento, aparece

como siendo únicamente "nada mas que pura información" el

contenido de información de un ordenador, como un sistema, equipado

con algún programa, se concentra en el contenido de información

del programa, que se puede considerar como un mensaje. Esto es consecuencia

del teorema de Turing (1912-1954), que hace posible en la actualidad, a un ordenador

simular, como una máquina que es, a cualquier otra máquina.

Las salidas de dicho sistema de computación

sólo están determinadas por sus programas, la información

generada sólo es función del contenido de información

del programa y las entradas.

Los trabajos de Mackay en el año 1950,

sugieren una alternativa a la teoría de Shannon, pues distingue

entre lo que llama el contenido métrico y el contenido lógico de la información.

Su información métrica es en muchos

aspectos semejante a la de Shannon y es la que puede procesar el ordenador.

Por otra parte sus contenidos lógicos expresan

una propiedad completamente diferente en la naturaleza. El contenido lógico

se define como el número mínimo de los sistemas más

fundamentales que especifican un fenómeno dado, expresado sobre

alguna base lógica. En otras palabras, se habla de acerca del mínimo

de sistemas irreducibles, necesarios en orden a especificar un sistema

dado desde un punto de vista formal.

Después se han expuesto otras teorías, como la "teoría algorítmica de la información", por

parte de Solomonof, Martin-Löf Kolmogorov y posteriormente por Chaitin.

|

Computadora u ordenador es una máquina capaz de aceptar información de entrada, efectuar

operaciones lógicas y aritméticas, y proporcionar la información resultante a través de un medio de salida, todo ello sin intervención de un operador humano y bajo el control de un programa de instrucciones previamente almacenado en él mismo.

|

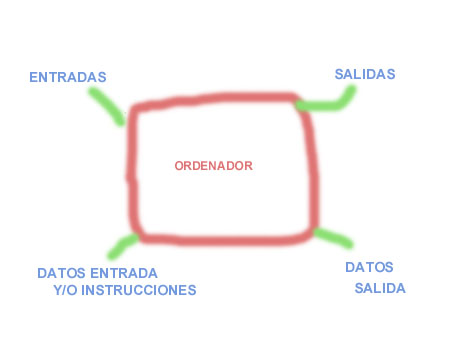

Un ordenador se puede considerar como un sistema,cuyas salidas o resultados son función de sus entradas, constituidas por datos e instrucciones.

Los datos son un conjunto de símbolos

usados para expresar o representar un valor numérico, un hecho,

un objeto o una idea, en la forma adecuada para ser objeto de tratamiento.

Son datos: la matrícula de un coche, el domicilio

de una persona, el título de un libro, etc.

Los datos pueden ser captados directamente por el

ordenador mediante sensores adecuados (Ej.: temperatura o sonido) o

pueden ser datos representados en forma de letras y números (grafismos).

Los grafismos usados en Informática para

representar los datos están constituidos por:

-

Caracteres numéricos.{0..9}

-

Caracteres alfabéticos.{a..z, A..Z}

-

Caracteres especiales.{., ), {, ...}

-

Caracteres gráficos.{Ô, ?,

©, ...}

-

Caracteres de control.{^P, ...}

Las salidas de un programa se denominan también datos, pudiéndose eventualmente utilizar éstos como datos de un programa posterior.

Es decir, la palabra dato se usa como contraposición a instrucción.

Hablando desde el punto de vista físico, un ordenador se define como una máquina que transforma la energía libre en calor y trabajo matemático.

|

|

|

2 Codificación de la información

¿Qué es un ordenador?, partes que lo integran

9 octubre 2003 |

Codificación es representar los elementos de un conjunto mediante los de otro, de tal forma que a cada elemento del primer conjunto le corresponda un elemento distinto del segundo.

Ejemplo de codificaciones:

-

Código de provincia en las matrículas de los coches.

-

Número de carné de identidad.

Veremos más adelante que en el interior de los

ordenadores la información se almacena y se transfiere de un sitio

a otro según un código que utiliza sólo dos valores

(código binario), representados por 0 y 1.

Bit es la unidad de cantidad de información.

|

La física y las matemáticas se han puesto de acuerdo en tomar como unidad de información, la cantidad de información que disminuye nuestra ignorancia en dos veces y permite hacer una elección entre dos posibilidades equitativas.

Por el aspecto cuantitativo se entiende su estructura estadística, es decir, la frecuencia con que los símbolos o sus combinaciones pueden aparecer,

I = lg(base b) k/n

donde k/n es la probabilidad del estado E, otra forma de expresar esta ecuación, más análoga a la fórmula de Shannon, es:

I = lg (base b) 1/p(e)

Si se considera un mensaje de m símbolos extraídos de un alfabeto de n símbolos, entonces p(E) es la probabilidad de un mensaje de longitud m, de un alfabeto de n símbolos y su valor es 1/nm

De la fórmula anterior se deduce que,

I = lg (base b) nm = m*lg (base b) n.

Por ejemplo, se supone un suceso que pueda presentar

dos estados posibles, un interruptor abierto o cerrado, sólo se

necesita un símbolo para transmitir el estado del suceso y un alfabeto

de dos símbolos (por ejemplo 0 y 1). La información asociada

al conocimiento del estado del interruptor será,

I = lg(base b) 21

I = 1 bit

Si la base del logaritmo es 2, la unidad de información se llama bit, que se puede definir como "Cantidad de información obtenida al especificar una de las dos alternativas igualmente probables".

Ejemplos:

Se supone un televisor con 500 filas y 600 columnas, con 10 niveles

de brillo. La información asociada a una imagen sería:

Alfabeto: 10 símbolos (n)

Longitud mensaje: 300000 (m)

Probabilidad imagen: 1/núm. Casos posibles = 1/nm

Información: lg(base 2) 10300000 = 106 bit

Si en un sorteo de un coche entre un millón, le toca a una persona, esta recibe una información:

lg (base 2) 1/10-6 = 20 bit

Un bit es una posición que toma el valor 0 ó

1. La capacidad mínima de almacenamiento de información en

el interior de un ordenador es el bit, es decir, es la unidad indivisible

de información.

Anteriormente indicamos que la información

se representa usualmente por medio de caracteres y que internamente se

codifica en un alfabeto binario, es decir en bit. Por tanto a cada carácter

le corresponde un cierto número de bit.

Ejemplo:

-

A ---- 0001 0000

-

L ---- 1101 0101

Un byte u octeto, es el número de bits necesarios para almacenar un carácter, generalmente es 8, por lo que byte es sinónimo de 8 bit.

La capacidad de almacenamiento de un ordenador se suele medir en bytes. Se suelen usar múltiplos de esta unidad:

1 kB (1 kibibyte) = 210

Bytes = 1024 Bytes.

1 MB (1 Mebibyte) = 220

Bytes = 1048576 Bytes.

1 GB (1 Gibibyte) = 230

Bytes = 1073741824 Bytes.

De acuerdo con el IEC (International Electrotecnical Commision), los prefijos respecto a las unidades en informática son:

- kibi (ki) 10^3

- mebi (Mi) 10^6

- gibi (Gi) 10^9

- tebi (Ti) 10^12

- pebi (Pi) 10^15

- exbi (Ei) 10^18

|

|

3 ¿Qué es un ordenador? Partes que lo integran

¿Qué es un ordenador?, partes que lo integran

9 octubre 2003 |

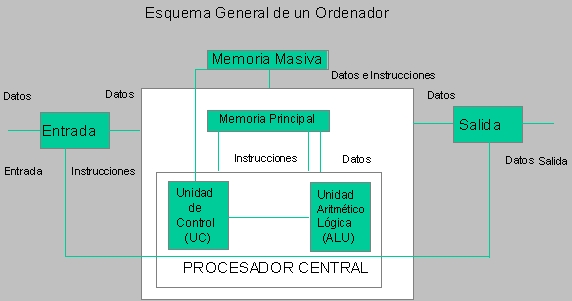

Esquema general de un ordenador

Seguidamente se da una breve explicación de cada uno de los elementos anteriores:

Unidad de entrada:

Dispositivo por donde se proporcionan al ordenador los datos e instrucciones.

Ejemplos: teclado, tableta digitalizadora, ratón, etc.

Unidad de salida:

Dispositivo a través del cual se obtienen

los resultados de los programas ejecutados. Ejemplos: pantalla, impresora, etc.

Memoria:

Es la unidad donde se almacenan tanto los datos como las instrucciones. Hay dos clases básicas de memoria:

-

Memoria principal o interna:/li>

Es la que actúa con mayor velocidad y está

ligada directamente, por tanto, a las unidades más rápidas.(Unidad

de control y Unidad Aritmético Lógica).

Hay dos tipos de memoria principal: RAM y ROM.

RAM o memoria de acceso directo se

caracteriza porque el usuario puede leer o escribir en cualquier posición.

Es una memoria que se borra cuando se desconecta el ordenador.

Hay varios tipos, hasta hace poco tiempo se han utilizando mucho la FPM

(Fast Page Mode), EDO (Enhaced Data Output) y la BEDO (Burst EDO),

aunque actualmente se están uando masivamente memorias

con tecnologías más avanzadas como las Síncronas (SDRAM).

Posteriormente se desarrolló un nuevo tipo de memoria, por la empresa

Mosaid Technologies Inc, denominada

Syncrhonous Link DRAM (SL-DRAM), que permite la transferencia de datos

con velocidades de hasta 800 MOctetos/s.

Para la difusión de esta tecnología se ha creado un consorcio, SL-DRAM Inc, que incluye a IBM, Nec y Texas Instruments entre sus miembros. Otro hecho importante de estas memorias es su interface adaptativa, que ajusta automáticamente la cadencia con la que se transfieren los datos, con una exactitud de fracciones de nanosegundo. Otro nuevo tipo de memoria ha sido desarrollado por Ramtron International Corp., la conocida como enhaced synchronous DRAM (ESDRAM), como una variación de las SDRAM. A nivel de PC, el desarrollo más nuevo es la memoria RAMBUS, específica para ordenadores con placa base con circuitos de Intel

ROM o memoria de sólo lectura,

es también de acceso directo pero el usuario sólo puede leer

de ella. Por lo general esta tiene grabados de fábrica programas

o datos de gran interés, que no pueden ser alterados por éste,

ni se borran al desconectar e ordenador. Existen varios tipos, algunos

son borrables por radiación ultravioleta o por electricidad, son

conocidas como EPROM y EEPROM respectivamente. Actualmente se

usan las denominadas FLASH, con la ventaja de que el usuario puede

regrabarlas, directamente desde un programa de ordenador, cuantas veces desee.

-

Memoria masiva auxiliar, externa o secundaria:

La memoria principal aunque es muy rápida,

no tiene gran capacidad para almacenar información.

Para guardar grandes cantidades de información

se usan otros tipos de memoria tales como discos y cintas magnéticas,

que son más lentos pero tienen más capacidad. La información grabada en un disco

permanece casi indefinidamente hasta que el usuario la borre.

ALU (Unidad aritmético lógica).

Contiene circuitos electrónicos con los

que se hacen las operaciones de tipo aritmético (sumas, restas,

etc.) y de tipo lógico (comparar dos números, etc.).

UC (Unidad de control).

Detecta señales de estado procedentes de

las distintas unidades indicando su situación o condición

de funcionamiento. Capta de la memoria una a una las instrucciones del

programa y genera señales de control dirigidas a todas las unidades,

poniendo en marcha las operaciones que implican la ejecución de

la instrucción.

Estas unidades se conectan unas con otras según el esquema visto anteriormente, mediante

buses.

Se denominan periféricos de un ordenador

al conjunto de sus unidades de entrada/salida y de memoria masiva. Al resto

de unidades (memoria principal, UC, ALU) se le denomina ordenador central.

La unidad de procesamiento central o CPU

es el conjunto de UC y ALU.

Aunque habitualmente se habla de dos marcas (Intel y Motorola) de microprocesadores, en el mercado hay otras muchas, en la página de CPU

Info Center (no está actualizada) se puede encontrar información, y una revisión histórica.

Programas e instrucciones

Una instrucción es un conjunto

de símbolos que representan una orden de operación o tratamiento

para el ordenador. Un programa es un conjunto ordenado

de instrucciones que se dan al ordenador.

Las instrucciones se construyen siguiendo unas reglas

precisas y con símbolos de un determinado repertorio. Todo lo relativo

a los símbolos y reglas para construir un programa se denomina lenguaje

de programación.

Los circuitos electrónicos de la unidad de control del ordenador sólo pueden interpretar instrucciones de un determinado lenguaje, denominado lenguaje máquina, cuyas instrucciones

están formadas por bit (ceros y unos). El lenguaje máquina presenta dificultades:

-

Depende del modelo de microprocesador.

-

Repertorio de instrucciones muy reducido.

-

Es laborioso programar con él.

Para evitar estos problemas se han ideado lenguajes

de alto nivel, que no dependen del ordenador y facilitan la programación.

Hay programas denominados traductores que

traducen programas escritos en un lenguaje de alto nivel a programas en

lenguaje máquina. Ejemplos de lenguajes de alto nivel: BASIC, Pascal,

Fortran, Cobol, Logo, C, Ada, Java, etc.

Otros programas que las casas comerciales suministran

es el conjunto de programas que constituyen el sistema operativo

(también conocido como sistema de explotación) que son necesarios

para la utilización eficiente y cómoda del ordenador. Ejemplo

de funciones de estos programas: copiar un programa de disco a memoria

o viceversa, borrar un conjunto de datos de un disco.

Ejemplo de programa:

Se supone que el Bello Chocolatón está intentando hacer un pastel de chocolate, siguiendo las instrucciones de la siguiente receta:

(Caso de que no resulte bien, se puede adquirir uno como el de la imagen)

-

1- Tomar un tazón

-

2- Tomar 2500 g de azúcar

-

3- Tomar 500 de leche en polvo

-

4- Tomar un tarro de almíbar de 333 g

-

5- Tomar un paquete de nueces

-

6- Tomar un paquete de chocolate en polvo

-

7- Tomar una barra de mantequilla

-

8- Tomar extracto de vainilla, 60 g

-

9- Poner en el tazón 2.5 tazas de azúcar

-

10- Poner en el tazón 3/4 de taza de leche en polvo

-

11- Poner en el tazón 1/3 de taza de almíbar

-

12- Poner en el tazón dos cucharadas de mantequilla

-

13- Tomar un recipiente separado

-

14- Poner una taza de nueces y 350

g de chocolate en polvo, en el recipiente separado y ponerlo aparte

-

15- Mezclar juntos en el tazón

todos los ingredientes, excepto las nueces y el chocolate

-

16- Echar la mezcla en una cacerola y ponerla a calentar

-

17- Calentar durante 5 minutos, removiendo lentamente

-

18- Quitar la cacerola del fuego y

remover con una cucharada de extracto de vainilla

-

19- Mezclar con las nueces y el chocolate,

removiendo hasta que se derrita el chocolate

-

20- Echar la mezcla en un molde untado

de mantequilla y dejar enfriar

-

21- Comer, siempre que existan garantías

de que no produzca problemas al consumidor.

|

Esta receta es una lista de instrucciones que se deben

seguir exactamente, para cocinar con éxito el pastel. Esta lista

se tiene en un pedazo de papel, mientras que en el ordenador estaría

en la memoria. En el caso de la receta se deben ejecutar las instrucciones

en el orden indicado, si no queremos que salga cualquier otra cosa, de

forma análoga la unidad central de procesamiento debe ejecutar las

instrucciones en el orden en que están listadas en la memoria del

ordenador. Una alteración del orden puede llegar a provocar una

catástrofe.

Una vez que se tienen las instrucciones, se deben

leer e interpretar, empezando por la primera instrucción. En el

caso de la receta, leemos la instrucción y vemos el significado

en nuestro cerebro. El procesador hace lo mismo, transfiriendo el código

de la instrucción a sus circuitos de almacenamiento y utilizando

sus circuitos de decodificación y control para decidir qué

operaciones hay que realizar para ejecutar la instrucción. En la

receta se van acumulando productos, esto es análogo al proceso de

entrada e inicialización del programa, al principio.

Por otra parte al mezclar las nueces y el chocolate

y ponerlos aparte, es análogo al proceso que realizan los ordenadores

de almacenar en memoria números o caracteres para su empleo posterior.

Una vez que el sistema ha sido inicializado al estado

adecuado, el procesador comienza a seguir las instrucciones del programa,

con el que se pretende llegar a un resultado final. En el caso de la receta,

las instrucciones son, calentar la mezcla cinco minutos, en un ordenador el proceso equivalente podría ser sumar dos números o poner en marcha un aparato de aire acondicionado.

Por último en el paso penúltimo de la receta, se ha de lograr una presentación adecuada, análogamente en un programa de ordenador sería la de presentar el resultado de forma legible para el usuario, por ejemplo dar los resultados en una impresora y de forma fácilmente comprensible.

Soporte físico (hardware) y soporte lógico(software).

El soporte físico, hardware de un

ordenador es la máquina en sí, es decir, el conjunto de circuitos

electrónicos, cables, carcasas, dispositivos electromecánicos

y otros elementos físicos que lo forman.

El soporte lógico o software es el

conjunto de programas (sistema operativo, de utilidades y de los usuarios)

ejecutables por el ordenador.

Para que un ordenador funcione es necesario utilizar

programas, es decir, con tan sólo la circuitería no funciona,

tan imprescindible es el hardware como el software.

Organización de los datos

Los datos e informaciones que se dan o almacenan

en un ordenador, no se introducen y guardan sin orden y al azar, sino que

se estructuran y planifican de una forma adecuada, según un determinado

formato que deciden los programadores y analistas.

Fichero o archivo es un conjunto de información

del mismo tipo (homogénea), tratada como una unidad de almacenamiento

y organizada de forma estructurada para la recuperación de un dato

individual.

Ejemplos de ficheros:

Fichero de historias clínicas de enfermos de un determinado hospital.

Fichero de empleados de una empresa.

Fichero de alumnos de la universidad.

Fichero de libros de una biblioteca.

| REFERENCIA |

TITULO |

AUTOR |

GENERO |

EDITORIAL |

| E001 |

Quijote |

Cervantes |

Novela |

Anaya |

| A9874 |

Pepita Jiménez |

J. Valera |

Drama |

Anaya |

| I7890 |

MS DOS |

A. Marín |

Informática |

Mc. Graw |

Los registros son las estructuras o unidades que forman un fichero.

Ejemplo de registros:

-

La información contenida en una historia clínica.

-

Los datos referentes a un empleado determinado.

-

Los datos de un determinado alumno.

-

Los datos referentes a un libro.

Cada línea de la figura anterior se corresponde a un registro.

Campo es una variable o dato que forma parte de un registro y representa una información unitaria o independiente.

Son campos por ejemplo:

-

El nombre de un enfermo, su lugar de nacimiento, el domicilio, etc.

-

El nombre del empleado, su carnet de identidad, puesto que ocupa.

-

El nombre de un alumno, curso que realiza, calificaciones, etc.

-

El autor de un libro, la editorial, el género, el título del libro.

En la tabla cada columna es un campo.

Los campos están compuestos de caracteres.

Un mismo centro puede efectuar diversas aplicaciones

que utilizan los mismos datos y si para cada aplicación introducimos

los mismos datos, la información estará duplicada en la memoria

del ordenador. Estas duplicidades dan lugar, si no se evitan, a que se

tarde más o se ocupen más personas en introducir datos, sea

más complejos depurar errores, se ocupe más memoria, etc.

Es más lógico introducir los datos una sola vez. Nace así el concepto de

|

Base de Datos

es una organización sistemática de datos orientada a facilitar

su acceso, recuperación y actualización, por diversos programas

o usuarios, y que incluye las relaciones entre datos. |

|

|

4 Tipos de ordenadores

¿Qué es un ordenador?, partes que lo integran

9 octubre 2003 |

1. Clasificación de los ordenadores atendiendo al uso o propósito para el que fueron

diseñados y construidos:

-

Ordenador de uso general: Puede utilizarse para muchos tipos de aplicaciones. Tales como gestión administrativa, cálculo científico, etc.

-

Ordenador de uso específico: Es el que únicamente puede utilizarse para una aplicación concreta. Ejemplo, el que contiene un robot, control del tráfico, etc.

2. Clasificación según tipo de procesador.

Atendiendo a cómo se procesan los datos en la CPU hay dos grandes clases de ordenadores:

-

Ordenador analógico: Los datos se representan por señales físicas (eléctricas, por lo general) cuyas amplitudes son proporcionales a sus valores. Se utilizan usualmente para resolver ecuaciones matemáticas por simulación.

-

Ordenador digital: Los datos se representan por señales eléctricas discretas (no continuas) que sólo pueden tomar dos valores.

3. Clasificación según tamaño:

-

Super ordenadores: Pueden ser utilizados simultáneamente por muchos usuarios, en cálculos científicos o de simulación. Su coste es por lo general es de decenas de millones de euros y su velocidad es enorme.

-

Mainframes o grandes ordenadores: Son equipos dedicados a gestión, por lo que admiten gran cantidad de trabajos simultáneos, como por ejemplo controlar una red de terminales en las sucursales de una empresa, o una red de cajeros automáticos de un banco.

-

Superminiordenadores: Son equipos en principio dedicados a tareas departamentales dentro de una empresa. Su capacidad principal es la de soportar gran cantidad de terminales, pues están orientados

a la gestión. Dado su bajo precio en comparación con los grandes ordenadores, están cogiendo cuota de mercado frente a ellos.

-

Miniordenadores: Son equipos que admiten unas cuantas terminales. Están orientados a la gestión. Actualmente son poco competitivos frente a los microordenadores de gama alta.

-

Estaciones de trabajo ("Workstations"): Son equipos monousuario, dotados de gran capacidad de cálculo y con enormes prestaciones gráficas. Se utilizan principalmente en la investigación científica y en aplicaciones técnicas, como por ejemplo la simulación. Su precio está bajando y actualmente son competitivas con los microordenadores de gama alta. Estos equipos no sirven para aplicaciones de gestión.

-

Ordenadores personales o microordenadores: Son equipos ampliamente difundidos, de precio reducido y de prestaciones suficientes no sólo para el nivel personal, sino para pequeñas empresas. Actualmente

se están conectando entre sí, formando grandes redes lo cual los hace adecuados para entornos más exigentes, sustituyendo en muchos casos a los miniordenadores.

-

Consolas de juego: A esta categoría pertenecen equipos con prestaciones orientadas principalmente al entretenimiento doméstico.

4 Clasificación según el ámbito de uso:

Esta clasificación se realiza en función

del ámbito de aplicabilidad para el cual cada máquina concreta ha sido diseñada y comercializada.

-

Ordenador de bolsillo: Los más difundidos son los conocidos como PDA (Personal Digital Asistant).

Hay dos grandes marcas en lucha constante:

Palm, pionera en la fabricación de estos aparatos, que conserva su propio estilo, con su propio sistema operativo, el Palm OS y con mucho software disponible tanto de pago como de código libre. Pocket PC, estándar desarrollado por Microsoft, adaptando sus Sistemas operativos de PC y portátiles a estos pequeños aparatos y sobre el que decenas de empresas fabrican sus PDA. Entre ellas encontramos a HP y Canon.

-

Ordenador doméstico: Pensado para juegos, aprendizaje asistido por ordenador de diversas materias, gestión de agendas, pequeñas contabilidades domésticas, etc.

-

Ordenador profesional: Diseñado para satisfacer las necesidades informáticas de una amplia gama de profesionales y también de pequeñas oficinas técnicas o empresas familiares.

-

Ordenador departamental: Ordenador con capacidad local para abordar con autosuficiencia la mayoría de necesidades de un departamento, pero vinculado a un ordenador de mayor potencia y capacidad de archivos para aquellos procesos que requieren una mayor potencia en el procesador.

-

Ordenador central: Ordenador central de la empresa al cual recurren todos los usuarios cuando la capacidad local está desbordada.

-

Red de ordenadores: Conjunto de ordenadores vinculados entre sí para ofrecer un mismo tipo de servicio a todo un conjunto muy amplio de usuarios de forma repartida para evitar sobrecargas y evitar que la caída de un ordenador único central represente la caída de todo el servicio.

Un poco de humor... (en francés)

Se muestran algunas frases bastante célebres de "visionarios" de la informática. Es posible que algunas sean inventadas.

Je pense qu'il y a un marché mondial pour environ 5 ordinateurs.

Thomas WATSON, président d'IBM, 1943.

Les ordinateur du futur ne pèseront pas moins d'une tonne et demi.

Popular Mechanics, 1949.

J'ai parcouru le pays de long en large et parlé avec les meilleurs personnes, et je peux vous assurer que Informatique est une lubie que ne durera pas plus d'un an.

Editeur chez Prentice Hall, 1957.

A quoi ça peut-il bien servir?

Ingénieur chez IBM à qui l'on présentait une puce électronique, 1968.

Il n'y a aucune raison que des gens veuillent un ordinateur à la maison.

Variante:

Les gens n'ont pas besoin d'un ordinateur chez eux.

Ken OLSON, PDG et fondateur de DEC, 1977.

640Ko est suffisant pour tout le monde.

Bill GATES, PDG et fondateur de Microsoft, 1981.

Si vous ne pouvez le faire bien, rendez le beau.

Bill GATES, PDG et fondateur de Microsoft.

Je crois qu'OS/2 est destiné à être le système d'exploitation le plus important de tous les temps.

Bill GATES, PDG et fondateur de Microsoft, 1988.

L'époque des PC est terminée. Lou Gerstner, Directeur d'IBM, 1998.

|

***

*** |

Pronto disponible

687474703A2F2F7777772E627573636F637572736F732E6E65742F6D6564696F5F616D6269656E74652D736C6374656D613130302E68746D637572736F73206D6564696F20616D6269656E7465cursos medio ambiente.it |

|

| | |

| |