Actualizada en http://www.um.es/docencia/barzana/IACCSS/Informatica-ciencias-sociales.html

Si ponemos un recipiente con un jarabe dulce

en las proximidades de una colmena, en cuanto una de ellas accede

a él y lo prueba, pasa poco tiempo antes de que lleguen las restantes

en abundancia, procedentes de la misma colmena. De alguna forma, la primera

en acudir ha transmitido la información sobre la existencia del

jarabe a las otras. El científico austríaco C.

Frisch (1886-1982)

realizó una serie de experimentos sencillos de los que dedujo la

forma en que se trasmitía la información, como se indica seguidamente.

Si el jarabe se ha situado a menos de 100 m de la colmena, la abeja que llega con la noticia transmite la información mediante un baile circular. Pero si el jarabe se pone a más distancia, el baile cambia por completo, la abeja corre un poco en línea recta, rápidamente meneando el abdomen por los lados, después de una vuelta completa a la izquierda, de nuevo corre en línea recta y da una vuelta entera por la línea de un arco de circunferencia, pero hacia la derecha.

Además el ritmo del baile depende de la distancia, a 100 m la abeja en 15 s hace 10 ciclos enteros, a 200 m hace siete ciclos, a 1000 m hace cinco ciclos y a seis km sólo hace dos. El baile contiene la información que indica en la dirección en la que se debe volar.

Como la información la da dentro de la colmena, efectúa la parte rectilínea de

su baile con un ángulo determinado respecto a la fuerza de la gravedad.

Marcando abejas, se ha comprobado que el 88% de ellas, con la información recibida de la que descubrió el jarabe, llegan al sitio donde este se encuentra.

Las hormigas y los escarabajos

Observando la vida de las hormigas, se descubrió

que a las muertas otras las transportan, fuera del hormiguero, en

cuanto se transmite de alguna forma la información de que está

muerta, que no suele ser de inmediato, es decir que una hormiga puede estar

muerta varios días bajo la indiferencia del resto, hasta que aparece

de golpe cierta seńal y las hormigas la llevan a un lugar alejado.

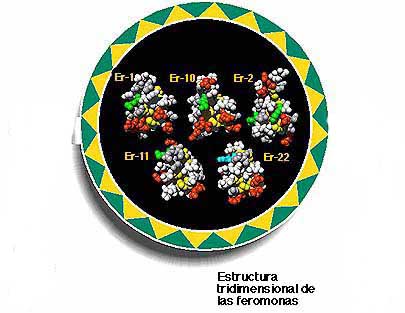

La explicación está en el olor que desprenden unas sustancias conocidas en biología como

feromonas (también supuestamente responsables de la atracción entre distintos

sexos, y que se suelen vender en tiendas de artículos de magia)

en el momento en que se desprende el olor  característico

de que está muerta una hormiga el resto la llevan fuera del hormiguero.

Si a una hormiga viva se le impregna de la feromona correspondiente, el

proceso es como si estuviera muerta y aunque vuelva al hormiguero repetidas

veces, la sacan fuera mientras que persista el olor.

Estudios recientes indican el posible uso de estas feromonas de hormiga

para tratar la enfermedad de Alzheimer. Según algunas informaciones pseudocientíficas en la especie humana se da el caso curioso de que las mujeres rubias y pelirrojas tienen más cantidad de una feromona determinada, con lo cual suelen ser más atractivas

para los hombres. Las que se tińen el pelo no consiguen este efecto.

característico

de que está muerta una hormiga el resto la llevan fuera del hormiguero.

Si a una hormiga viva se le impregna de la feromona correspondiente, el

proceso es como si estuviera muerta y aunque vuelva al hormiguero repetidas

veces, la sacan fuera mientras que persista el olor.

Estudios recientes indican el posible uso de estas feromonas de hormiga

para tratar la enfermedad de Alzheimer. Según algunas informaciones pseudocientíficas en la especie humana se da el caso curioso de que las mujeres rubias y pelirrojas tienen más cantidad de una feromona determinada, con lo cual suelen ser más atractivas

para los hombres. Las que se tińen el pelo no consiguen este efecto.

Por lo que respecta a los escarabajos descortezadores del pino, es

de gran interés el estudio de la comunicación química

de esta especie de gran importancia como plaga forestal, comenzando desde

el aislamiento e identificación de feromonas y atrayentes volátiles

del árbol hospedador, estudio de los mecanismos presentes durante

el proceso de colonización, el estudio de relaciones interespecíficas

a nivel de semioquímicos hasta el diseńo de las técnicas

para el uso de feromonas con fines de control.

Las mariposas

El lenguaje de los olores está muy difundido en el mundo de los animales. Entre ellos los más fuertes y de largo alcance son los relacionados con instinto de la reproducción.

Por ejemplo la hembra de la mariposa llamada "Los grandes ojos del pavo real" manda sus seńales hasta una distancia de 8 km, mediante un transmisor químico de potencia ínfima.

La industria de la perfumería no está en condiciones de competir con la naturaleza, el olor de los perfumes como mucho se aprecia a una decena de metros.

Los peces

En el ańo 1942, las falsas alarmas del sistema americano de defensa de costas en el Atlántico, fueron la causa del descubrimiento de los sonidos que emiten los peces, en este

caso denominados tamborileros. Se estableció que "suenan" aproximadamente en el mismo rango que la voz humana, de 5000 a 10000 Hz. Unas especies emiten un chirrido, otras murmullos, otras golpes sueltos y así se pueden clasificar en muchos tipos.

Se realizó el siguiente experimento:

en un acuario se introdujo un hidrófono y grabaron en cinta los

sonidos producidos por los peces al masticar la comida, posteriormente

reprodujeron estos sonidos en el acuario y los peces se acercaron al altavoz

pensando que allí había comida.

Los sonidos no son la única forma

de transmitir información por parte de los peces. Los que habitan

en grandes profundidades, tienen su fuente de luz. Esta consiste en faroles

biológicos con lentes, reflectores y hasta diafragmas. Sus impulsos

de luz pueden tener distintas frecuencias y diversas duraciones.

En áfrica los peces de la familia mormínidos, que habitan en ríos turbios y agitados, emplean

impulsos eléctricos para las comunicaciones. Estos peces tienen una especie de radares portátiles. Sus cuerpos son dipolos eléctricos, la cola tiene carga negativa y la cabeza positiva. Generando un campo eléctrico de una frecuencia dada, de forma que los objetos que se encuentran a su alrededor deforman el campo del dipolo, detectándolos de esta forma.

Las serpientes

<

Los zoólogos desde hace tiempo han comprobado que ciertas serpientes venenosas, como por ejemplo el ancistrodon (conocida como mocassin), tienen cuatro fosas nasales, las complementarias forman dos hoyos profundos.

En estos hoyos se ha descubierto una membrana que los divide en dos cámaras, y que está atravesada por un sinfín de terminaciones nerviosas, se ha comprobado que son termolocalizadores. Perciben la irradiación de calor, por lo que determinan la dirección hacia su origen.

Las serpientes tienen una vista muy débil, un olfato que casi no vale nada y un oído muy malo. Por eso durante el proceso de la evolución se desarrolló el sistema localizador de calor.

El hombre

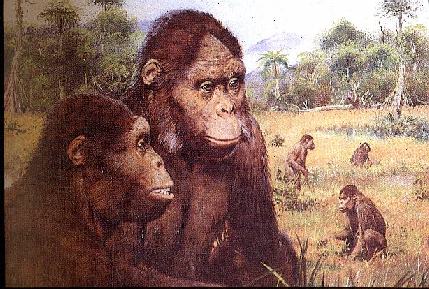

Según una hipótesis, nuestro antepasado común con los monos, dryopithecus, vivía

en los árboles, se alimentaba de vegetales y bajaba con poca frecuencia a la tierra, pues era peligrosa para él. Millones de ańos vivió en un laberinto de ramas y su organismo se adaptó a esta forma de vida en los árboles. Estos saltos de  rama

en rama, exigían no sólo músculos, sino vista aguda, cálculo y orientación rápida. Los ojos que en la mayoría de los animales miraban en diferentes direcciones, comenzaban a aproximarse

y a mirar hacia delante, se les creó la visión del volumen y del color. Se les complicó el cerebro y el sistema nervioso.

rama

en rama, exigían no sólo músculos, sino vista aguda, cálculo y orientación rápida. Los ojos que en la mayoría de los animales miraban en diferentes direcciones, comenzaban a aproximarse

y a mirar hacia delante, se les creó la visión del volumen y del color. Se les complicó el cerebro y el sistema nervioso.

El cambio de información en estos colectivos era elemental, contactos carińosos o bruscos, mímica y gestos y cierta cantidad de sonidos inarticulados. Estos sonidos formaban

de 10 a 15 combinaciones a las que condicionalmente llamaremos palabras.

El cambio de clima provocó que los

dryopithecus bajaran a la tierra, tomando una posición casi vertical

(así podían observar mejor el terreno) y las extremidades

delanteras se quedaron casi sin ocupación. La lucha por

la existencia pronto les encontró empleo, armadas con una piedra

o un palo se convirtieron en un recurso para conseguir alimentos y para

defenderse. Lo demás lo hizo el trabajo. Se perfeccionó el

cerebro y en respuesta el cerebro hizo más hábiles a las manos del hombre.

El trabajo era colectivo y por lo tanto exigía comunicación.

Las muecas y sonidos inarticulados eran insuficientes, siendo reemplazados

a lo largo del tiempo por la palabra oral y la escritura. Transición

que duró muchos miles de ańos.

El trabajo era colectivo y por lo tanto exigía comunicación.

Las muecas y sonidos inarticulados eran insuficientes, siendo reemplazados

a lo largo del tiempo por la palabra oral y la escritura. Transición

que duró muchos miles de ańos.

La población del mundo aumentaba

rápidamente, formándose tribus y pueblos aislados, apareciendo

la necesidad de la transmisión de la información a largas

distancias. Para este propósito se han empleado muchos medios, corredores

incansables, mensajeros a caballo, combinaciones de hogueras (indios),

tambores gigantes, palomas mensajeras.

Llegó un momento en que esto era

insuficiente, la vida exigía una transmisión de la información

más rápida. La electricidad hizo la revolución, apareció

el telégrafo por cable. El paso siguiente fue el invento del teléfono,

en la exposición mundial de París miles de personas hacían

cola para hablar a través de él con otros visitantes.

|

Atribuyen la invención del teléfono a un italiano La Cámara de Representantes (Diputados) de los Estados Unidos decidió darle el crédito de la invención del teléfono, hasta ahora atribuida al estadounidense de origen escocés Alexander Graham Bell, al italiano Antonio Meucci. "La vida y obra de Antonio Meucci deben obtener el justo reconocimiento, y su trabajo en la invención del teléfono debe serle atribuido", dice el texto, que fue aprobado por simple exclamación a partir de la propuesta de un legislador republicano de origen italiano, Vito Fosella, del estado de Nueva York. De este modo, los legisladores dieron por terminada una discusión histórica. La resolución es una revancha póstuma para Meucci, un florentino que emigró primero a Cuba y luego a Estados Unidos. Meucci tiene en Staten Island, estado de Nueva York, un museo, el "Garibaldi-Meucci", que es una especie de templo de la italianidad neoyorquina. Emily Gear, la directora del museo, dijo: "El teléfono lo inventó él, pero no tuvo suerte". Su historia, siguió, "refleja el drama de tantos inmigrantes todavía hoy, discriminados porque no pueden hablar la lengua del país que los hospeda". Según sostiene la Sociedad Histórica Italiana en América, la fama y la fortuna le fueron vedadas a este inmigrante florentino porque no contó con los 250 dólares necesarios para patentar su invento. Meucci descubrió los principios que guían el funcionamiento del teléfono en 1849 y desarrolló un aparato que funcionaba en 1859. En 1860 lo presentó en un diario local, escrito en italiano. Y el 28 de diciembre de 1871 dejó registrado su primer intento de solicitud provisoria, cinco ańos antes de que Bell llenara los papeles. Su patente temporaria N° 3.335 se venció al no poder afrontar los costos del trámite. El juicio que inició Meucci contra la Compańía Bell fundada por Alexander no llegó a buen puerto. Los papeles de su patente temporaria se perdieron misteriosamente. Según la resolución que aprobaron los legisladores la semana pasada, la patente fue acordada a Bell, quien trabajaba en el laboratorio en el que Meucci había depositado su material. Siguiendo el proceso por fraude, en 1887 las autoridades intentaron anular la patente entregada a Bell, pero en 1889 después de la muerte de Meucci, ocurrida en 1896 el caso fue cerrado. Tampoco se conoció jamás quién fue el comprador del primer aparato creado por él, que vendió por 6 dólares cuando estaba necesitado. "Dejémosle a Meucci el honor de ser reconocido como ''el Padre del Teléfono''. Dejemos Bell que tenga el dinero", dijo John La Corte, presidente de Sociedad Histórica Italiana en América. |

|

El mito del diez por ciento Alguien le robó la mayor parte del cerebro y Ud. probablemente no lo sabía. Bueno, no significa exactamente que le hayan quitado el cerebro, pero han decidido que Ud. no lo usa. Se trata del viejo mito, escuchado una y otra vez, que dice que la gente usa sólo el diez por ciento del cerebro. Mientras que para aquellos que repiten ese mito esto probablemente sea verdad, los demás felizmente usamos todo el cerebro. El mito y los medios Ese remanido supuesto del diez por ciento aparece todo el tiempo. El ańo pasado, los avisos publicitarios de la revista nacional para la U.S. Satellite Broadcasting mostraban el dibujo de un cerebro. Debajo figuraba la leyenda: Ud. sólo usa el 11 por ciento de su potencial. Bien, estuvieron más cerca que el mito del diez por ciento, pero todavía les faltó un 89. En julio de 1998, la cadena de televisión ABC emitió unos spots promocionales del programa The Secret Lives of Men (Las vidas secretas de los hombres), para la temporada de otońo. El spot consistía en una propaganda en la que se podía leer, Los hombres sólo usan el diez por ciento del cerebro ocupando toda la pantalla. Una de las razones por las cuales este mito ha permanecido, es que ha sido adoptado por videntes y otros integrantes del mundo paranormal para explicar los poderes parapsíquicos. En más de una ocasión he escuchado a videntes que le dicen a la audiencia Solamente usamos el 10 por ciento de la mente. Si los científicos no saben lo que hacemos con el 90 por ciento restante, ˇentonces debemos estar usándolo para los poderes parapsíquicos! En Reason To Believe: A Practical Guide to Psychic Phenomena (Razón para creer: guía práctica para los fenómenos parapsíquicos), el autor Michael Clark menciona a un hombre llamado Craig Karges. Karges cobra un montón de dinero por su programa Intuitive Edge (Al filo de la intuición), el cual está diseńado para desarrollar habilidades parapsíquicas naturales. Clark cita a Karges diciendo: Normalmente utilizamos sólo del 10 al 20 por ciento de la mente. Piense cuán diferente sería su vida si Ud. pudiera usar ese otro 80 ó 90 por ciento, que conocemos con el nombre de mente subconsciente (Clark 1997, 56). También ésta fue la razón que dio Caroline Myss intentando explicar sus poderes intuitivos en una sección de Eye to Eye with Bryant Gumbel (Ojo a ojo con Bryant Gumbel, o Frente a frente con Bryant Gumbel), que se emitió en julio de 1998. Myss, que ha escrito libros sobre el desarrollo de los poderes intuitivos, dijo que todo el mundo tiene dones intuitivos, y lamentó que usáramos tan poquito del potencial de la mente. Para empeorar las cosas, apenas una semana antes, en el mismo programa, se había presentado información correcta acerca del mito. Entre el programa y la publicidad, aparecía en pantalla un spot con una breve encuesta: żQué porcentaje del cerebro usamos? Las respuestas, tipo multiple-choice (de elección múltiple) iban desde el 10 hasta el 100 por ciento. Apareció la respuesta correcta, lo cual me alegró. Pero si los productores sabían que lo que había dicho una de las entrevistadas era clara y manifiestamente erróneo, żpor qué permitieron que saliera al aire? żEl cerebro derecho no sabe lo que está haciendo el cerebro izquierdo? Tal vez la entrevista a Myss era una repetición, en cuyo caso los productores presumiblemente chequearon los hechos después de que se emitió al aire y sintieron la responsabilidad de corregir el error en la emisión de la semana siguiente. O posiblemente las emisiones se difundieron en secuencia y los productores simplemente no se preocuparon y emitieron a Myss y a su desinformación de todos modos. Incluso Uri Geller, quien construyó su carrera tratando de convencer a la gente de que podía doblar metales con la mente, salió al ruedo con esta perlita. Esto aparece en la introducción de su libro Uri Gellers Mind-Power Book (El libro de los poderes mentales de Uri Geller): Nuestras mentes son capaces de proezas notables, increíbles, y todavía no las utilizamos en su plenitud. De hecho, la mayoría de nosotros usamos sólo cerca del 10 por ciento del cerebro, con suerte. El otro 90 por ciento está lleno de habilidades y potenciales aún no descubiertas, lo cual significa que nuestras mentes operan en forma muy limitada en lugar de funcionar a pleno. Creo que alguna vez tuvimos pleno poder sobre nuestra mente. Lo hacíamos para sobrevivir, pero a medida que el mundo se sofisticó y se hizo más complejo nos olvidamos de muchas habilidades que alguna vez tuvimos (énfasis en el original). Evidencia en contra del mito del diez por ciento El argumento que dice que los poderes parapsíquicos provienen de la vasta parte del cerebro no utilizada se basa en la falacia lógica del argumento por ignorancia. En esta falacia, la falta de pruebas para sostener una posición (o simplemente la falta de información) se usa para tratar de apoyar una suposición determinada. Aunque fuera cierto que la mayor parte del cerebro humano no se usa (lo cual no es cierto), eso de ninguna manera implica que haya alguna capacidad extra que pueda darle a la gente poderes parapsíquicos. Esta falacia surge constantemente en las afirmaciones paranormales, y prevalece especialmente entre los partidarios de los OVNI. Por ejemplo: dos personas ven una extrańa luz en el cielo. El primero, un creyente en los OVNI, dice, ˇMira allí! żPuedes ex-pli-carme eso? El escéptico contesta que no, que no puede. El creyente en los OVNI se regocija. ˇJa! ˇNo sabes lo que es, por lo tanto debe tratarse de extraterrestres! dice, argumentando desde la ignorancia. Lo que sigue son dos de las razones por las cuales el mito del diez por ciento resulta sospechoso. (Para un análisis más extenso y detallado del tema, véase el capítulo de Barry Beyerstein en el nuevo libro Mind Myths: Exploring Everyday Mysteries of the Mind, 1999 [Mitos de la mente: explorando los misterios cotidianos de la mente]). 1) Las técnicas de investigación por imágenes tales como los PET (Tomografía por emisión de positrones) y la FMRI (resonancia magnética funcional por imágenes) muestran claramente que la mayor parte del cerebro no permanece inactiva. En verdad, aunque ciertas funciones menores pueden utilizar sólo una pequeńa parte del cerebro en un momento determinado, cualquier conjunto de actividades o patrones de pensamiento complejos usarán muchas partes del mismo. Así como una persona no utiliza todos los músculos a la vez, tampoco utilizan todo el cerebro a la vez. Para ciertas actividades, tales como comer, mirar televisión, o leer The Skeptical Inquirer, usted puede usar unas pocas partes específicas del cerebro. Sin embargo, en el transcurso del día se utilizarán casi todas las partes del cerebro. 2) El mito presupone una localización extrema de las funciones cerebrales. Si las partes usadas o necesarias estuvieran dispersas por todo el órgano, esto implicaría que de hecho se necesita gran parte del cerebro. Pero el mito implica que la parte utilizada del cerebro es un área discreta, limitada, y la parte no utilizada es como un apéndice o amígdala, que ocupa espacio pero es esencialmente innecesaria. Pero si todas esas partes del cerebro no se usan, el hecho de remover o dańar las partes no usadas no conllevaría grandes efectos o ni siquiera se notaría. Sin embargo las personas que han sufrido traumas cerebrales, un infarto, u otro dańo cerebral, frecuentemente se encuentran severamente impedidos. żHa escuchado Ud. a algún médico decir, afortunadamente cuando la bala penetró en el cráneo, solamente dańó el 90 por ciento del cerebro, que no usaba? Por supuesto que no. Variantes del mito del diez por ciento El mito no es simplemente algo estático o un malentendido. Tiene diversas formas, y su adaptabilidad le da una vida más prolongada que la que tiene un spam laqueado. En su versión básica el mito afirma que ańos atrás un científico descubrió que nosotros utilizamos verdaderamente sólo el 10 por ciento del cerebro. Otra variante se refiere a que sólo el 10 por ciento del cerebro ha sido mapeado, y que esto se malinterpretó mapeado por usado. Antes, Craig Karges había presentado una tercera variante. Ésta dice que, de alguna manera, el cerebro se encuentra ingeniosamente dividido en dos partes: la mente consciente que se usa del 10 al 20 por ciento del tiempo (presumiblemente a plena capacidad); y la mente subconsciente, en donde el restante 80 ó 90 por ciento del cerebro permanece inutilizado. Esta descripción revela un profundo malentendido de la investigación de las funciones cerebrales. La larga vida del mito se debe en parte a que si una variante resulta incorrecta, la persona que cree en ella puede simplemente cambiar la razón de su creencia y apoyarse en otra base, mientras la creencia misma permanece intacta. Así, por ejemplo, si a un individuo se le muestra un examen PET en donde se observa actividad en todo el cerebro, todavía puede seguir argumentando que lo del 90 por ciento se refiere a la mente subconsciente, y por lo tanto la figura del mito queda a salvo. Independientemente de la variante, el mito se repite y se expande, sea por gente bien intencionada o por aquellos que mienten deliberadamente. La creencia que permanece es, entonces, lo que Robert J. Samuelson denominó un psico-hecho (psycho-fact), una creencia que, a pesar de no estar sólidamente basada en los hechos, se toma como real porque su constante repetición cambia la manera en que experimentamos lo que vivimos. El lego va a repetirlo una y otra vez hasta que, tal como sucede con la advertencia de no tirarse al agua después de comer, termine por convertirse en una creencia ampliamente difundida. (Triumph of the Psycho-Fact, Newsweek, May 9, 1994.) Los orígenes del mito no son del todo claros. Beyerstein, del Laboratorio de comportamiento cerebral de la Universidad Simon Fraser en British Columbia, lo ha rastreado hasta principios del siglo veinte. En una reciente columna de la revista New Scientist también se sugirieron otras fuentes, incluyendo a Albert Einstein y Dale Carnegie (Brain Drain 1999). Probablemente tenga un sinnúmero de fuentes, principalmente la malinterpretación o malentendido de los hallazgos científicos legítimos así como los gurúes de autoayuda. El más poderoso atractivo del mito es probablemente la idea de que podemos desarrollar poderes parapsíquicos o al menos lograr ventajas competitivas tales como mejorar la memoria y la concentración. Todo esto se encuentra a nuestra disposición, como dicen los avisos, si aprovechamos el más poderoso de nuestros órganos, el cerebro. Ya es tiempo de desechar este mito, aunque si ha sobrevivido casi un siglo, seguramente continuará vivo en el próximo milenio. Quizá la mejor manera de combatirlo sea contestar a nuestro interlocutor, cuando lo mencione, Ah, ży qué parte no usas? Benjamin Radford The Skeptical Inquirer, March-April 1999 Traducción de Alejandro Borgo Benjamin Radford es Jefe de Edición de la revista The Skeptical Inquirer y es graduado en psicología. Agradecimientos Estoy en deuda con el Dr. Barry Beyerstein por sus sugerencias y ayuda en la investigación. Referencias Beyerstein, Barry. 1999. Whence cometh the myth that we only use ten percent of our brains? In Mind-myths: Exploring Everyday Mysteries of the Mind and Brain, edited by Sergio Della Sala. New York: John Wiley and Sons. Brain Drain. 1999. The Last Word (column). New Scientist 19/26 December 1998-2 January 1999. Clark, Michael. 1997. Reason to Believe. New York: Avon Books. Geller, Uri, and Jane Struthers. 1996. Uri Gellers Mind-power Book. London: Virgin Books. Tomado de Sin dioses |

petroglifos, signos e imágenes grabados en las piedras.

petroglifos, signos e imágenes grabados en las piedras.

El paso siguiente fue el invento de la imprenta. A su ayuda llegó la fotografía y más recientemente el cine. Más tarde se inventaron dispositivos para grabar y reproducir los sonidos. Al principio era un sencillísimo fonógrafo, siendo desplazado por el magnetófono y sus posteriores versiones actuales.

La aparición de los ordenadores exigió la creación de dispositivos de memoria de elevadas capacidades, que han ido evolucionando con el tiempo: tarjetas perforadas, relés

electromagnéticos, núcleos de ferrita, discos magnéticos, memorias de semiconductores, discos ópticos y experimentalmente memorias de bacterias y holográficas. Sin embargo actualmente no se han logrado memorias del tipo de la humana, tanto por su arquitectura como por su capacidad.

![]()

3.2 Las ondas, portadoras de la información

La primera posibilidad del hombre de transmitir la información aparece junto con el primer grito que da al nacer, después empleamos este medio toda la vida.

Hay quien piensa que cualquier información de por sí misma tiene la propiedad de pasar por el espacio sin ayuda de algún portador que circule por este espacio. El sonido viaja por el espacio debido a las oscilaciones del aire. El que habla, con sus cuerdas vocales hace oscilar el aire, que transmite esta información a las siguientes capas de aire y así sucesivamente. Si creamos un vacío alrededor de un orador, por ejemplo de los que leen monótonamente una conferencia, ya no se le oirá, y el auditorio podrá dedicarse a dormir.

Aproximadamente lo mismo ocurre al difundir cualquier información en el espacio. Un barco que pasa lejos se detecta en la orilla por las olas que llegan, las han traído las

oscilaciones de las partículas de agua.

La información se transmite en el espacio solamente con la ayuda de un proceso que se propague en el espacio. A este proceso oscilatorio móvil lo llamamos ondulatorio. En función del medio ambiente oscilante, las ondas pueden ser de mar, de sonido, de radio, etc. Estas ondas son los mensajeros que difunden la información por el espacio, hay algunas que van

a la máxima velocidad posible, la velocidad de la luz, mientras que otras transmiten la información muy despacio, como por ejemplo las ondas en los líquidos viscosos. Este movimiento ondulatorio aparece en casi todas las ramas de la Física.

El movimiento de una onda únicamente

depende del tipo de onda y del material a través del cual se propaga,

pero no depende del movimiento del cuerpo que provoca la onda. Cuando una

fuente emisora lleva una velocidad mayor que la velocidad de la onda se

produce una onda de choque (utilizadas para desintegrar cálculos

renales con equipos de litotricia), como por ejemplo los estampidos sónicos

de los aviones y la radiación de Vavilov-Cherenkov.

Una onda de choque transporta toda la energía ondulatoria emitida

a lo largo de la trayectoria del movimiento de la fuente en un estallido violento.

Supongamos un muelle metálico muy largo (el juguete conocido en EE.UU como "slinky") y lo ponemos de lado a lado de una habitación. Entonces agrupamos con la mano unas cuantas

espiras, cerca de uno de los extremos del muelle.

Este grupo de espiras comprimidas parece

moverse como un rizo hacia el otro lado del muelle. Viaja de esta forma

hasta el extremo más alejado, una vez allí parece rebotar

y vuelve al punto en el que se inició el proceso. Este proceso se

repite sucesivas veces, pero la región comprimida se hace más

ancha y su contorno menos definido. Al final es difícil reconocer

esta región. El movimiento se ha extendido a todo el muelle y se

observa un temblor y una agitación general. Al final el muelle permanece

en reposo. Cualquiera que efectúe el proceso

antes descrito con el muelle debe de comprobar que algo se mueve hacia

delante y atrás en el muelle. Sin embargo ni un solo trozo de metal

se ha desplazado más de unos pocos centímetros de su posición

inicial. żQué fue lo que se movió a través de la habitación?

Lo que se movió fue la silueta de espiras del muelle, la región en donde estas espiras estaban más juntas de lo normal. Cualquier silueta o forma que se desplace se puede

llamar una onda.

Ondas

Ondas

Podemos ser más precisos y definir como

perturbación cualquier distribución de las partes de un sistema

que sea diferente de su condición de reposo natural. Una onda física

es una perturbación que se mueve debido al efecto que las partes

del sistema ejercen entre sí.

Una onda se puede utilizar para enviar

información. Supongamos que apagamos las luces, y que en cada extremo

del muelle se pone una persona. Las seńales se envían mediante

la contracción de espiras en un extremo, notándose en el

otro extremo la región comprimida. Una vez finalizado el movimiento

se puede enviar otra seńal. Para enviar mensajes largos se puede

utilizar un código semejante al Morse.

La onda que se enviaba a través del

muelle, se producía comprimiendo algunas espiras del muelle. Las

ondas en las que la perturbación coincide con la dirección

del movimiento se conocen como ondas longitudinales o de compresión.

Sin embargo las conocidas como ondas transversales, la perturbación

forma un ángulo recto con la dirección de propagación

de la onda. Las ondas sonoras son longitudinales, mientras

que las que se producen en la superficie del agua son en su mayor parte

transversales. Las ondas luminosas son transversales.

Hasta el momento se han comentado ondas en las que la perturbación inicial dura muy poco tiempo, y en las que la perturbación no se volvía a repetir. Se conocen como pulsos. Cuando una perturbación que produce la onda se repite a intervalos regulares de tiempo, se tiene un tren de ondas. Por ejemplo, al cantar se produce un tren de ondas sonoras. Los trenes de ondas difieren entre sí en la rapidez con que se repiten los pulsos. El tiempo transcurrido entre la repetición de los pulsos recibe el nombre de período, que se representa por T. La frecuencia es  el número de repeticiones por segundo y se representa por la letra f.

el número de repeticiones por segundo y se representa por la letra f.

La relación entre la frecuencia y el período de un tren de ondas regular es muy simple. El producto de la frecuencia por el período es siempre igual a uno. El producto

de la longitud de onda por la frecuencia es igual a la velocidad de propagación

de la onda. La unidad de frecuencia es el Hercio (Hz), que corresponde a un ciclo por segundo.

Una forma de crear un tren de ondas sonoras

es dar palmadas rítmicamente. Cada palmada envía un pulso

sonoro. Al dar palmadas sucesivas se crea un tren de ondas. Si entre cada

una transcurre un segundo, el período será de un segundo y

la frecuencia un Hercio. Al dar la segunda palmada, el pulso

sonoro producido por la primera se habrá desplazado una distancia

considerable, si la velocidad del sonido es de 350 m/s, el primer pulso

lleva una adelanto de 350 m respecto al siguiente. Si se da una palmada

cada segundo, se produce un tren de pulsos sonoros espaciados 350 m entre sí.

La longitud de onda es la distancia entre

dos pulsos consecutivos, por lo que en este caso la longitud de onda será

de 350 m. Si se dan dos palmadas por segundo, la longitud

de onda será de 175 m. Entonces se llega a la conclusión

de que el producto de la longitud de onda por la frecuencia de cualquier

tren de ondas es igual a la velocidad de propagación de la onda.

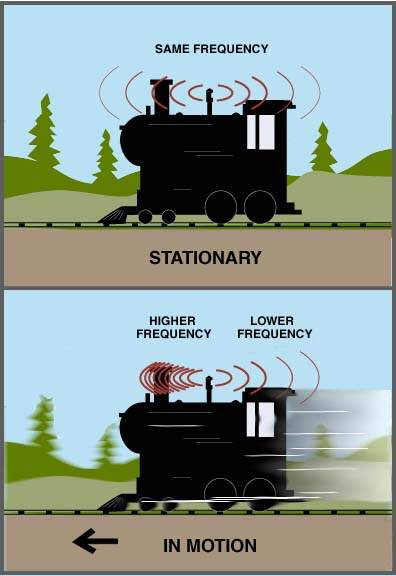

El efecto Doppler. En una autopista, si

estamos parados, es habitual oír el sonido de los vehículos

que circulan por ella, procedentes de los ruidos de los motores. Es fácil

advertir la variación del sonido cuando nos adelanta otro vehículo.

Es obvio que la mayoría de los vehículos no disminuyen su

velocidad al sobrepasarnos. El tono varía en función de la

trayectoria seguida hasta llegar a nuestros oídos. Este desplazamiento

de la frecuencia se llama efecto Doppler, muy utilizado en diversos campos,

por ejemplo en los radares de la Guardia Civil, astronomía y medicina

(ecografías abdominales, patologías del sistema circulatorio,

patologías testiculares).

Este efecto se debe al cambio de frecuencia de una onda, debido al movimiento de la fuente que emite las ondas, o al del observador que recibe la energía de la onda.

Si se considera un coche desplazándose

a la velocidad de 35 m/s, y cuyo conductor hace sonar el claxon cada segundo,

al pitar por segunda vez, el pulso primero se ha desplazado 350 m (la velocidad

del sonido), pero durante este tiempo el coche se ha desplazado 35 m desde

el lugar de partida. Los dos pulsos mantendrán una distancia de

315 m entre sí. Un observador alejado recibirá más

de un pulso por segundo. La distancia de cada pulso es 315 m y la velocidad

en el aire es 350 m/s. El tiempo transcurrido desde que el observador escucha

un pulso sonoro y el siguiente es 315/350 ó 0.9 s. Si el claxon

continúa pitando se pueden llegar a oír diez pitidos en nueve

segundos. En general se puede decir que: un observador situado frente a

una fuente sonora en movimiento recibirá los pulsos sonoros con

una frecuencia mayor que la emitida por la fuente. En caso de alejamiento

la frecuencia será más baja.

Si estamos al aire libre y alguien nos llama

desde lejos, normalmente podemos distinguir la dirección en que

nos llega el sonido. Esto nos indica que se propaga en línea recta.

Por ora parte, si alguien sale de la habitación en que nos encontramos

y nos llama desde el pasillo, seguimos escuchando su voz. Entre ambos puede

haber una pared que nos sirva de pantalla para las ondas sonoras. El sonido

es capaz de encontrar un camino a través de la puerta abierta y

alcanzar nuestros oídos; en este caso su trayectoria no es una línea

recta. Esto indica que las ondas sonoras pueden bordear obstáculos.

Se conoce como difracción el proceso

mediante el cual las ondas vencen obstáculos. En cualquier caso

la magnitud de la difracción depende de la relación existente

entre el tamańo de los obstáculos y la longitud de onda de la onda.

Cuando las ondas encuentran en su camino obstáculos del mismo tamańo o más pequeńos

que su longitud de onda, tienden a bordear el obstáculo.

Una onda electromagnética es un conjunto

de voltajes en el espacio, que se mueve con el tiempo. La teoría

básica de la electricidad y el magnetismo,(para quien no conozca

los conceptos básicos de las magnitudes más habituales en

electricidad se indican en el siguiente

enlace) debida a James Clerk Maxwell, indica que para crear ondas electromagnéticas se han de acelerar cargas eléctricas. Una vez formadas, esta teoría

también predice su comportamiento. Se propagan en el espacio libre con la velocidad de 300000 km/s, y en otros materiales a velocidades inferiores.

Las ondas electromagnéticas se pueden detectar debido a la energía que transportan. Estos detectores pueden ser muy variados, como por ejemplo los electrones que se encuentran en la antena de un coche, o bien las cargas eléctricas que poseen los átomos de la retina de nuestros ojos.

El espectro de ondas electromagnéticas es muy amplio, varía desde las ondas de radio, de muy baja frecuencia, hasta rayos gamma, cuya longitud de onda es más pequeńa que

el núcleo de un átomo.

|

La longitud de onda es la característica

fundamental de estas ondas. Un sistema eficaz para detectar o producir

estas ondas debe ser un dispositivo del mismo tamańo que la longitud

de onda de las ondas que se quieren producir o detectar. Por ejemplo, una

antena de radio es demasiado grande para generar ondas de luz visible,

los átomos de nuestros ojos son demasiado pequeńos para detectar

ondas de radio.

Ondas de radio AM y FM. Una seńal de radio que transmite siempre la misma onda no transporta mucha información. Pero al menos informa al receptor de que la estación que envía la seńal está en funcionamiento. Para obtener más información, hay que variar y comprender la seńal que se detecta. Es el proceso de la modulación.

El tipo de modulación más

simple consiste en variar la duración de los intervalos de tiempo

entre seńales. Puede transmitirse una secuencia de trenes de ondas

más largos o más cortos mediante el código morse o

algún otro conocido. A principios del siglo XX la primera utilidad

de las seńales electromagnéticas fue el envío de mensajes

telegráficos a través del océano para grandes distancias.

Es muy fácil variar gradualmente

la intensidad de la seńal desde su valor máximo al mínimo,

a lo largo de muchos ciclos de la onda repetitiva elemental, este método

se conoce como modulación de la amplitud (AM).

Un parámetro importante es el porcentaje de modulación, que indica la amplitud mínima o nivel cero de la onda modulada. Una modulación al 100% indica que la amplitud mínima será cero.

Se puede demostrar matemáticamente que la onda modulada final se puede descomponer en tres seńales: una de frecuencia igual a la portadora y otras resultado de sumar y restar la frecuencia de la moduladora a la de la portadora. Es decir, si tuviéramos una portadora de 500 KHz y la onda moduladora posee una frecuencia máxima de 20 KHz (como las seńales musicales) obtendremos tres ondas: una de 500 KHz y dos bandas laterales de 480 KHz y 520 KHz.

Esto es importante para saber el ancho de banda que ocupa la transmisión (en este caso 20+20=40 KHz).

Con este sistema pueden aparecer algunos problemas, la intensidad de la seńal puede variar por razones distintas a las de la modulación que provoca la emisora, las cargas de la atmósfera pueden crear efectos no deseados. Esto provoca distorsión y ruido en el receptor.

Para evitar el problema previo, se utilizan ondas de frecuencia modulada (FM), muy popular en la actualidad. En este sistema la onda que transporta

la información no posee una frecuencia única. Su frecuencia

varía en función de la intensidad de la seńal de modulación.

Para descifrar estas seńales hace falta un circuito más complicado

que las de AM, pero la distorsión atmosférica afecta poco

en la transmisión, por lo que la calidad de recepción es mucho mejor.

Supongamos que tenemos una seńal moduladora cuya máxima amplitud es de 1V (valor de pico) y una onda portadora de 1000 KHz. Si suponemos que para este valor de amplitud la frecuencia de la portadora se desvia 15 KHz (simétricamente, es decir +15 KHz y -15 KHz), conforme oscile la seńal moduladora la frecuencia de la portadora oscilará entre 985 KHz y 1015 KHz, ocupando un ancho de banda de 30 KHz.

En este sistema de modulación también tenemos un problema práctico, y es que rara vez el ancho de banda de la transmisión es inferior a diez veces el de la seńal moduladora.

Internacionalmente se han dividido todo el espectro de frecuencia en las denominadas bandas de frecuencia. Esto se hace así para poder delimitar el acceso de los usuarios a estas bandas. Hay que mencionar que este clasificación no es global y que algunos paises difieren en su delimitación, pero en general podemos aceptarlas como generales.

| Denominación | Siglas | Margen de frecuencias |

| Frecuencias muy bajas | VLF | 3 - 30 KHz |

| Frecuencias bajas | LF | 30 - 300 KHz |

| Frecuencias medias | MF | 300 - 3000 KHz |

| Frecuencias altas | HF | 3 - 30 MHz |

| Frecuencias muy altas | VHF | 30 - 300 MHz |

| Frecuencias ultra altas | UHF | 300 - 3000 MHz |

| Frecuencias super altas | SHF | 3 - 30 GHz |

| Frecuencias extra altas | EHF | 30 - 300 GHz |

Las bandas de frecuencia más baja se reservan para las emisoras que transmiten en AM, mientras que las de FM transmiten sobre los 100 MHz.

La única banda que está libre para cualquier uso (como radiocontrol) y para cualquier persona es la banda de los 27 MHz, pero debido a esto está bastante saturada y sólo es conveniente utilizarla para practicar con montajes caseros y sistemas de poco alcance (no más de 100m).

![]()

3.3 La información como magnitud fundamental

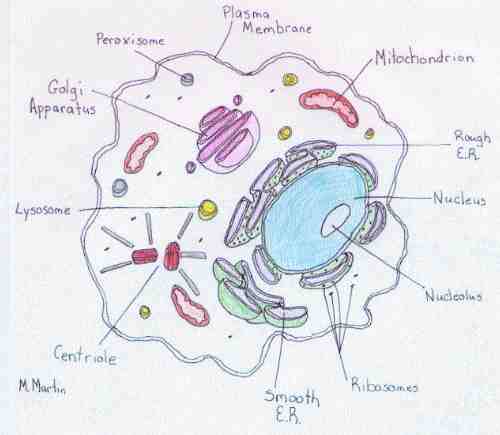

La información nos sale al paso en

cualquier momento, ya sea en sistemas técnicos como en los naturales:

en la elaboración de datos, en la tecnología de las comunicaciones

y en la de regulación, en las lenguas naturales, en los sistemas

de comunicación biológicos, incluso en la transmisión

de informaciones en la célula viva. La información se ha

convertido, pues, en la tercera magnitud básica universal. Debido

al enorme desarrollo realizado por la tecnología de ordenadores,

el sector de la informática ha alcanzado una importancia que era

escasamente predecible. Además la palabra información se

ha convertido en una expresión aplicable a las más diversas

disciplinas. Alcanzando al mismo tiempo una importancia esencial en los

sectores más dispersos como por ejemplo, la técnica, la biología

y la lingüística. Por lo tanto el concepto de información

requiere un tratamiento profundo, especialmente en el sentido de precisar

su significado, definir sus características más primordiales

y formular teoremas.

Algunos ejemplos de la vida real

Un organismo vivo recibe toda la información

hereditaria de sus progenitores. El catálogo entero de detalles

de una futura persona está "embalado" en un volumen increíblemente

pequeńo, en un óvulo, cuyo diámetro es tan sólo

de una décima parte de milímetro.

Todo lo vivo está compuesto de células,

cuyo elemento básico es el núcleo, donde se encuentra la

información hereditaria. Todo ser vivo nace como resultado de la

reproducción de muchísimas copias de una célula inicial

fecundada, proceso que se desarrolla a gran velocidad, se puede tener una

idea considerando que a partir de la célula inicial se llegan a

26 1012 células en un recién nacido.

Los núcleos de todas las células

contienen los denominados cromosomas, en número constante para cada

especie. El hombre 46, el mosquito zumbador 6, la carpa 104 y el chimpancé

48. En los cromosomas están las moléculas de ácido

desoxirribonucleico (ADN), al que la evolución ha confiado la misión

de ser el portador de la información genética. El ADN tiene

gran capacidad para duplicarse.

El ADN está formado por los nucleótidos,

y cada uno de ellos consta de moléculas de azúcar desoxirribosa

(D), de un grupo fosfato (F) y de una de las cuatro bases nitrosas: adenina

(A), timina (T), citosina(C) o guanina (G). Dos cadenas de ADN se

unen en una espiral doble como si se enrollasen la una en la otra, las

bases nitrosas se encuentran en el espacio interior entre las espiras y

están unidas entre sí con enlaces de hidrógeno. La

Adenina siempre hace pareja con la timina y la guanina con la citosina.

El número de nucleótidos en la molécula de ADN es

de muchos miles.

El mecanismo de duplicación del ADN, se puede describir de la siguiente forma. Los enlaces de hidrógeno que unen las dos espirales de ADN se desgarran al dividirse las células. La espiral doble se desenrolla, y en cada espiral separada, inmediatamente se construye otra nueva, complementaria. En lugar de una se han formado dos nuevas espirales dobles de moléculas de ADN absolutamente idénticas a la inicial, y así sucesivamente. De esta forma se transmite la

información.

Las moléculas de ADN constituyen

la mayor densidad de información conocida, El tamańo es de

2 nm de diámetro y 3.4 nm de altura por cada espira de la hélice.

Lo cual implica un volumen de 10.68 10-21 cm3 por

espira. En cada espira se encuentran 10 letras del alfabeto químico

(nucleótidos) resultando una densidad de información de 0.94

1021 letras por cm3. No obstante en el alfabeto genético existen

sólo cuatro bases nucleótidos: adenina, timina, guanidina

y citosina. El contenido de información de una de estas letras es

de 2 bit por nucleótido. La densidad de información es por

lo tanto 1.88 1021 bit/cm3.

Si se supone que el hombre tiene menos de cienmil

genes y se quisiera codificar la información hereditaria en el sistema

binario, se tendrían del orden de 2 107 bit. Si se graba

la información en cinta magnética, la longitud sería

de dos kilómetros, mientras que si se desenrolla la espiral hereditaria del ADN y

se estira en línea recta, la longitud sería solamente de

unos dos metros. Lo cual da idea de lo compacto que es el embalaje de la

información hecho por la naturaleza.

Aovillando, que es ADN

Preguntaba Rigel, hace algunas entradas, żCómo se almacenan los kilómetros de escalera

adenosa en sitio tan chiquitito como es una célula?

Me gusta la pregunta. Me gusta porque me da pie a desvariar un poco sobre un par de cosas,

y a asustaros con numeritos, que es algo que siempre alegra mi malvado y negro corazón.

Procedamos al susto:

La "escalera adenosa" de una célula no alcanza el kilometraje ni de lejos. Haciendo unos

pocos cálculos, que os ahorro, se ve que si estiramos todo el genoma humano, contenido

en el núcleo de una célula, tenemos un filamento de poco menos de unos dos metros de largo.

-- Oiga, ży de gordo, cuánto?

-- Dos nanómetros. O sea, dos milmillonésimas de metro.

-- żMande?

-- Digámoslo así: żve la división en milímetros de una regla?

-- Bueno, con las gafas y tal...

-- Pues imagine ese milímetro, dividido un millón de veces. żPuede?

-- No.

-- Ni yo. Así de chiquitito es un nanómetro.

-- Caray.

-- Y que lo diga.

Sea como sea, dos metros de hilito no son cosa nimia que empaquetar. Si se limitaran a

estar enrollados sobre sí mismos, sería un desastre. Hay que tener en cuenta una cosa

importante: el genoma no es una cosa que simplemente "está ahí". Es una parte muy dinámica

de la célula, que tiene que acceder continuamente a la información contenida en ella; ahora

este gen, ahora el otro, ahora este trozo de aquí, ahora el de allá. La visión de los

cromosomas como esas X gorditas que se ve en los libros sólo ocurre cuando la célula está

ocupada en dividirse. El resto del tiempo, el ADN es un ovillo medio suelto de ADN y

proteínas que se conoce como "cromatina" y cuya estructura es muy complicada y tiene varios

niveles de empaquetamiento.

Matemáticos, a mí: leí hace tiempo que el tipo de empaquetamiento que usa el ADN es el más

eficiente que existe. No lo sé. Pero sé que a la célula le va muy bien. Paso a describirlo,

poco a poco.

La hebra de ADN desnudita se enrolla en torno a una especie de "carrete" proteico formado

por cuatro proteínas llamadas histonas, cuya importancia es imposible exagerar. Esto es lo

que se llama "estructura en collar de perlas", por razones obvias. Hay una quinta histona

por ahí, enzarzada con el trozo de ADN que enlaza cada una de las "perlas", pero esto es

hilar finito. El collar, como véis ahí en el dibujito, es de unos 11 nanómetros de grosor:

ni siquiera el doble que el ADN desnudo.

Sigo: el "collar de perlas" se enrosca sobre sí mismo en lo que se llama un "solenoide",

de nuevo por razones obvias. La estructura tiene ahora 30 nanómetros de grosor,

El solenoide, a su vez, conserva la flexibilidad y características de un hilo (una fibra

de cromatina), que a su vez se enrosca más sobre sí mismo, en plan cable de teléfono, hasta

formar la hebra del cromosoma. En este punto la hebra tiene 700 nanómetros de grosor. El

cromosoma completo, con sus dos cromátidas y tal, es de unos 1400 nanómetros de grosor.

Tres órdenes de magnitud más que la hebra desnuda. żEsto es mucho, o poco? Extrapolemos:

si partimos de un hilito de un milímetro de grosor (proporcionalmente tan largo como el

ADN de un cromosoma), y lo empaquetamos como un cromosoma, el paquete resultante tendrá

un metro y pico de grosor. No está mal.

żY qué tal en cuanto a la longitud? żCuánto hemos conseguido acortar la hebra para que

quepa en el núcleo? Vamos a verlo: este sistema de empaquetamiento consigue que la longitud

de la hebra de ADN se reduzca cincuenta mil veces. Que se dice pronto. Si queréis os asusto

con más numeritos: el cromosoma más largo del genoma humano mide 263 millones de pares de

bases (todo el genoma son unos tres mil millones). Estiradito, eso son, a grosso modo, nueve

centímetros. Tras el empaquetamiento, no llega a las veinte diezmilésimas de milímetro de largo.

Así que, żcómo se almacena el ADN en la célula? Pues, la verdad... la mar de bien.

Y como fin de fiesta, para aquellos a los que les dé pereza lo negro, todo lo anterior está

perfectamente explicado en este bello dibujo, que además (astucia supina) es un enlace a una

página anglosajona donde se explican más cosas aún. El que no sepa más de cromatina después

de esto, es ya porque no quiere. De nada.

La Biblioteca de Babel

Toda la materia viva, desde el virus más

primitivo hasta el hombre son cadenas transportadoras para transmitir la

información hereditaria, son sistemas de comunicaciones perfectamente

construidos, que tienen una asombrosa exactitud para transmisión

de sus datos, con una gran defensa contra la acción de diferentes

interferencias, y realizados en unas dimensiones increíblemente

pequeńas.

El ADN "cumple" 50 ańos

La determinación de que el ADN transmite información genética de un individuo a su descendencia se concretó hace ahora 50 ańos. Durante este tiempo, el interés por esta sustancia química de la que están hechos nuestros genes y, por tanto, el libro de instrucciones para fabricar a un ser vivo, no ha hecho más que aumentar, hasta el punto de que la estructura del ADN (de doble hélice) se ha convertido en un icono en el mundo científico.

Redacción Ondasalud.com

La determinación de la estructura en doble hélice del ADN se considera uno de los hitos científicos del siglo XX. James Watson y Francis Crick la publicaron por vez primera vez en la revista Nature y ahora, cincuenta ańos más tarde, este medio festeja el hallazgo que culminó con la concesión del Premio Nobel de 1962 en Medicina y Fisiología a la célebre pareja.

żPor qué se celebra el quincuagésimo aniversario del descubrimiento de la estructura de doble hélice del ADN y no otros hallazgos científicos?

Para Robert Olby, del Departamento de Historia y Filosofía de las Ciencias de la Universidad de Pittsburgh, en Estados Unidos, para entender la magnitud de este acontecimiento científicos "primero tenemos que situarnos en 1953, otro mundo, en el que la revista científica aún no utilizaba la abreviatura de ADN para el ácido desoxirribonucleico".

Antecedentes

A principios de la década de 1950 existía un programa científico de investigación del ADN. "Estos estudios incluían el análisis de las propiedades físicas del ADN y se analizaba si su composición era igual para todas las células del organismo. Y también se discutía sobre el dańo de los rayos ultravioleta, entre otros factores, sobre este material génetica.

La mayoría de los investigadores eran bioquímicos y químicos y estaban especialmente interesados en dos aspectos: las mutaciones genéticas y cómo las proteínas realizaban el proceso de la síntesis, un tema especialmente importante para el crecimiento, la nutrición y la investigación en cáncer. "La progresiva investigación condujo a que ya en 1952 se viera al ADN como material hereditario".

Pero hacía falta mucha más información para convencer a toda la comunidad científica. żCómo justificar desde un punto de vista químico el papel del ADN en la herencia?, se preguntaban. La respuesta la aportó el trabajo de James Watson y Francis Crick. Describieron los pares de bases, donde la adenina fabrica uniones de hidrógeno con timina, y la guanina con citosina (las famosas cuatro letras A, T, C y G que forman el gran libro del genoma). "Este emparejamiento sugería un posible mecanismo de copiado para el material genético", escribieron en su artículo y, dos meses después ańadieron: "Hasta ahora no se había presentado ninguna evidencia que mostrara de qué forma puede consumarse el proceso esencial para el material genético, la duplicación exacta".

La constatación de que el descubrimiento de Watson y Crick era sumamente importante la suministraron Matthew Meselson y Franklin Stahl en 1958 al probar la naturaleza de la replicación del ADN.

La investigación siguió su curso hasta llegar al punto y seguido de esta bonita historia que fue la concesión del Premio Nobel de Medicina en 1962 a Watson, Crick y Wilkins.

Un retrato idealizado

La estructura de doble hélice que se ha popularizado hasta superar el entorno científico es una representación muy estética del ADN. En realidad, el aspecto del ADN es bastante diferente. Sin destruir la visión idealizada del modelo icónico propuesto por Watson y Crick, un científico relata en Nature que "en honor a la verdad, debemos explicar que la mayoría del ADN celular está comprimido en paquetes enmarańados y apelmazados que de alguna manera lo exponen de forma meticulosa al control regulador genético".

Según refleja este artículo, la doble hélice es una de las razones del éxito de los trabajos realizados sobre el ADN. "Ahora bien, no nos tenemos que dejar engańar por este retrato idealizado y debemos ser conscientes de la complejidad que posee la estructura de ADN y, por ello, reconocer el trabajo tan importante de sus descubridores".

Ejemplos de la vida real

Supongamos un ejemplo de la vida real, se

va por una carretera y se llega a una bifurcación. Si se desea saber

por ejemplo cual de las dos conduce a Murcia, lo lógico sería

ver los rótulos indicativos que suelen existir en las carreteras,

pero en este caso sólo hay grandes carteleras publicitarias (aunque

están prohibidas, pero como el alcalde se preocupa de pocas cosas),

por lo tanto la información recibida es nula, igual a cero. Si vemos

a otro coche que se acerca, se puede preguntar al conductor sobre cual

de las dos vías conduce a Murcia, respondiendo por ejemplo, la de

la derecha. Esta información recibida permite hacer una elección

entre dos posibilidades, es decir entre las dos posibles salidas. Se ha

recibido un bit de información.

Otros ejemplos habituales pueden ser:

żCuánta información obtenemos cuando nos dicen que cierta persona tiene el pelo oscuro, o que es una mujer? Parece de locos intentar cuantificar de forma precisa este concepto, pero lo vamos a hacer partiendo precisamente de su idea intuitiva.

Lo primero que debe quedarnos claro es que el hecho de obtener información es equivalente al de disminuir la indeterminación con respecto a algo, de tal forma que se obtiene tanta más información cuanto más disminuya el grado de incertidumbre que tenemos de cierto fenómeno.

Veamos esto con un ejemplo: Si se nos dicen las siguientes frases

-La persona que describo tiene el pelo oscuro.

-La persona que describo es mujer.

En la primera frase se nos da un dato de todos

los posibles (claro, castańo, pelirrojo, rubio, canoso), al

igual que en la segunda, (hombre, mujer, lesbiana, "gay", bisexual),

por tanto la primera y la segunda nos dan igual información, sin

embargo si en el segundo caso simplificamos y sólo consideramos

dos posibilidades (hombre, mujer), obtenemos más información

al disminuir mucho más la incertidumbre que teníamos con

respecto a la persona.

Otro ejemplo: El alfabeto espańol se compone

de 27 letras. Si un ordenador genera letras al azar, la información

que nos suministra el conocer que letra ha salido será mayor que

en cualquiera de los casos anteriores porque el número de estados

posibles es mayor (27).

Conclusión: La cantidad de información

que obtenemos con un mensaje es directamente proporcional al número

de estados posibles de la cuestión planteada.

Los matemáticos y los físicos

se han puesto de acuerdo que es lógico y cómodo tomar por

unidad de información una dosis de información tal que disminuye

nuestra ignorancia en dos veces y permite hacer una elección entre

dos posibilidades equitativas. Claro está que se ignora la importancia

de esta elección.

Un caso más complicado es la elección

entre cuatro salidas posibles. Por ejemplo, si hace falta prever en qué

trimestre se desean las vacaciones, se seguiría el proceso siguiente:

- żEn qué mitad del ańo? En la primera

- żEn que trimestre de la primera mitad del ańo?

En el segundo

Otro ejemplo es el esconder una moneda debajo

de una de entre cuatro tazas. żCómo encontrar la moneda

con sólo dos preguntas a las que se contesta si o no?

- żSe encuentra la moneda debajo de la primera o de la segunda

taza? No

- żSe encuentra la moneda debajo de la cuarta taza? No

La moneda, necesariamente ha de estar debajo de la tercera taza.

De los dos ejemplos previos, se deduce que

al hacer una elección entre cuatro opciones posibles, hacen falta

dos unidades de información y no una.

Si se escondiera la moneda debajo de una de entre

ocho tazas, para encontrarla harían falta tres unidades de información.

Así de forma sucesiva, aunque al aumentar el número de tazas

es más probable que rompamos alguna buscando la moneda. Se puede

observar una dependencia entre la cantidad de variantes N, u orígenes,

y la cantidad de unidades de información J, necesarias para tomar

una decisión,

y tomando logaritmos, se tiene

Esta fórmula fue propuesta en 1928

por Hartley, y dice, la información necesaria para la elección

entre N variantes equitativas es igual al logaritmo del número de

variantes.

El interés más evidente de la medida de la cantidad de información aportada por el resultado

de una experiencia, aparece cuando se trata de transmitir este resultado

a distancia. A continuación se describe un ejemplo muy ilustrativo,

supongamos que tu trabajas en una oficina en un pequeńo grupo formado

por cuatro empleados y el jefe. Este último por comodidad empleó

para llamar a sus empleados un sistema de comunicación muy sencillo:

un timbre suena y en un panel se enciende una de las cuatro lámparas

en las que están escritas las primeras letras de los nombres de

los empleados. Estas son A(Antonio), M(María), P(Procopio)

y U(úrsula). Supón que tu código sea A. Los primeros

meses se desarrollaba un proyecto conjunto con la participación

por igual de los cuatro y por lo tanto las llamadas del jefe implicaban

que las cuatro luces se encendieran con la misma frecuencia. (La información

era el log 4, es decir 2 bit). La probabilidad de que aparezca la luz en

tu lámpara o en cualquier otra, es .25

La función logarítmica crece

muy despacio al aumentar el número, esto implica que la cantidad

necesaria de información crece muy despacio al aumentar el número

de variantes. Por ejemplo, para tomar decisión entre 512 variantes,

sólo hacen falta 9 unidades de información, y si N es 4096,

hacen falta 12. Un ejemplo real de esta dependencia logarítmica

es cuando un juez de instrucción, recibiendo del acusado ávidas

contestaciones sólo en forma de las unidades de información

"si" o "no", rápidamente aclara un asunto. Sin duda, a él

ayuda la dependencia logarítmica previamente deducida.

Si en la fórmula ponemos N = 2 (log

2 = 1), se obtiene la dosis que tiene la unidad de información

que ha recibido el nombre de bit.

Claude E. Shannon fue el primero que formuló una definición matemática

del concepto de información en su trabajo " A mathematical theory of communication"

(1948). La medida que él utilizó, el bit (binary digit),

brindó la ventaja de permitir la definición cuantitativa

de causalidades que hasta ahora no había sido posible expresar de

una forma matemática exacta. La desventaja, no obstante, es evidente:

la información según el concepto de Shannon, no implica su

contenido intrínseco, sino que se limita a un aspecto especial,

que es significativo sobre todo para su transmisión y registro desde

el punto de vista técnico. En este caso, no se tiene en cuenta que

un texto sea razonable, comprensible, correcto o incorrecto o simplemente

no tenga significado alguno. Se desatienden aquí también

cuestiones importantes como el saber de dónde procede la información

(emisor) y a quien va destinada (receptor).

información en su trabajo " A mathematical theory of communication"

(1948). La medida que él utilizó, el bit (binary digit),

brindó la ventaja de permitir la definición cuantitativa

de causalidades que hasta ahora no había sido posible expresar de

una forma matemática exacta. La desventaja, no obstante, es evidente:

la información según el concepto de Shannon, no implica su

contenido intrínseco, sino que se limita a un aspecto especial,

que es significativo sobre todo para su transmisión y registro desde

el punto de vista técnico. En este caso, no se tiene en cuenta que

un texto sea razonable, comprensible, correcto o incorrecto o simplemente

no tenga significado alguno. Se desatienden aquí también

cuestiones importantes como el saber de dónde procede la información

(emisor) y a quien va destinada (receptor).

Para la definición "información"

de Shannon no tiene transcendencia alguna si una serie de letras representa

un texto de alto contenido temático o si, por el contrario, constituye

el resultado de un juego de dados. Efectivamente, y aun bajo el riesgo

de parecer paradójico, puede afirmarse que una serie de letras generadas

al azar ofrece, desde el punto de vista teórico informático,

un contenido máximo de información, mientras que un

texto cuyo lenguaje sea congruente, el valor correspondiente es menor.

La definición informática de Shannon se limita a un aspecto de la información,

esto es, el hecho de que a través de ella se exprese algo nuevo. Nuevo implica

el mayor efecto de sorpresa que se obtiene al aparecer un signo menos usual.

Información es, por lo tanto en este caso, la medida de improbabilidad

de un acontecimiento. Por esta razón, a un signo con alto grado

de improbabilidad se le concede un mayor contenido informativo.

Antes de que un emisor de signos origine

un signo, existe la duda de que signo especial va a emitirse de entre los

signos disponibles. Esta inseguridad desaparece tras haber recibido la

seńal. Según la forma de discernir de Shannon se define lo

siguiente: Información es la inseguridad que desaparece al recibirse

la seńal correspondiente. Teniendo en cuenta que Shannon sólo

está interesado en determinar la probabilidad de aparición

de los signos, automáticamente sólo registra el carácter

estadístico de la información. Con ello, el concepto de la

palabra información queda reducido a su aspecto carente de significado.

Según Shannon el contenido de la información queda definido

de forma que reúna las tres propiedades citadas a continuación:

Condición de adición: El contenido

de información de unos signos o series de signos independientes

el uno del otro, debe sumarse. Esta condición concibe la información

como algo cuantitativo.

Condición de probabilidad: El contenido

de información atribuido a un signo, o serie de signos debe aumentar

con el aumento progresivo de la sorpresa. El efecto de la sorpresa para

la letra w, con menor probabilidad de aparición, es mayor que el

de la letra e, con mayor probabilidad de aparición. De ello se deduce,

cuanto menos probable sea un signo, tanto mayor será su contenido

de información.

![]()

3.4 Información y mensajes

En un momento tu hiciste una proposición

muy original al jefe, y desde entonces casi se encendía solamente

la lámpara A. Esto hizo que en cuanto sonaba el timbre acudías

a la llamada del jefe, sin ni siquiera mirar la lámpara que se encendía.

Haciendo cálculos se llegó a que la probabilidad de que apareciera

la A era .97, mientras que para cada uno de los otros tres empleados era

.01, evidentemente la suma de las tres probabilidades es la unidad.

Se aprecia fácilmente que cuantas

más seńales o códigos de igual probabilidad se emplean,

tanto menor es la probabilidad de cada uno de ellos. Según Shannon,

para las seńales de igual y diferente probabilidad la cantidad de

información en su envío o código se determina por

la probabilidad de su aparición. Esta dependencia es también

inversa: cuanto más frecuentemente aparece el código, tanto

menos información lleva. Por eso tu no mirabas la lámpara

al sonar el timbre, a pesar de que de cada 100 llamadas había tres

que no eran tuyas. La aparición de la luz en la lámpara A

era segura y la cantidad de información que llevaba esa luz disminuyó

mucho, hasta log(1/.97), igual a .04 bit. Mientras que la información

de las seńales poco frecuentes aumentó considerablemente

a log(1/0.01)=3.32 bit.

La lotería puede ilustrar esto, supongamos un sorteo, el individuo mira la lista de los número premiados, después de estar un rato buscando ya ha perdido la esperanza y cada nueva búsqueda no le aporta ninguna información, de repente se pone radiante, ganó un millón de euros , si sólo hay un premio como este por cada millón, recibió de golpe una información

de log(1/.000001) lo que equivale a 20 bit.

Volvamos a la oficina, pasado cierto tiempo

la situación cambió por completo, poco a poco la lámpara

A dejó de encenderse. Entonces al comprobar que al sonar el timbre

ya no aparecía la luz de la letra A, te tapaste los oídos

con algodón. En esta situación el encenderse la luz de la

A, supone una gran cantidad de información, lo que pasa es que no

las notas al tener tapados los oídos, y son los compańeros

quienes te lo indican.

Fórmula de Shannon

Shannon dio una receta generalizada: hay

que calcular la información comunicada por cada código (en

este caso cada lámpara) y mediarla por todos los códigos

(por todas las lámparas). Pero no hay que mediarla del modo corriente,

sino por las reglas de las magnitudes causales: la información comunicada

por cada código se multiplica por la probabilidad de su aparición

y se suman todos los productos recibidos.

De esta forma se llega a la siguiente fórmula,

donde H es la entropía, las p son las probabilidades de que aparezcan los códigos y m el número total de códigos.

En el caso de las luces, para la situación en la que el jefe te llamaba continuamente, se tendría,

es evidente que para el período en que las cuatro luces se encendían con igual probabilidad, con esta expresión se llega a 2 bit, como se dedujo de la fórmula de R. Hartley.

Así la diferente probabilidad de la aparición de luz en las lámparas llevó a la disminución de la información que comunica el tablero de seńales, es

decir a la disminución de la entropía.

Información y significado

Existe una clase muy amplia de fenómenos

observables que se pueden asociar a cantidades numéricas, o a una

sucesión de cantidades numéricas, distribuidas en el tiempo.

Su estudio pertenece a la estadística. estas cantidades, o sus medidas

estadísticas, dan información sobre los fenómenos observados.

En una línea telefónica, o en un

circuito de televisión, o en un radar, tenemos unas cantidades,

las medidas de los voltajes de la corriente eléctrica que en un

cierto momento fluyen por el lugar donde hacemos la medida, que varían

muy rápidamente en el tiempo y que son susceptibles de ser estudiadas

desde un punto de vista estadístico. Los receptores telefónicos,

los filtros de onda, las redes de modulación de frecuencias, etc.,

han de poder procesar la información inherente a los cambios de

voltaje a un ritmo tan rápido como la variación de éste.

La información se ha de poder registrar, conservar, trasmitir y usar. Las ideas fundamentales sobre la cuestión de medir la información, pueden ser atribuidas a Claude E. Shannon, aunque hay otras personas que ayudaron a aclarar algunos conceptos fundamentales,

como por ejemplo Norbert Wiener.

Una teoría de la información es,

de hecho, una teoría de la medida de la información como

consecuencia de la idea de que ésta es medible. En 1922, R.A. Fisher

proponía una definición cuantitativa de la cantidad de información

contenida en datos experimentales susceptibles de tratamiento estadístico.

Más tarde, el desarrollo de las telecomunicaciones impuso la necesidad

de medir la información transmitida a través de un canal,

en este caso el hilo metálico.

La cronología del desarrollo del estudio de la teoría de la información podría resumirse del siguiente modo:

1928, R. Y. Hartley, en el congreso internacional de telefonía y telegrafía, propuso un método de comparación de los distintos sistemas transmisores de información.

1948, C.E. Shannon, partiendo del problema concreto de la transmisión por hilo, halla la medida de la cantidad de incertidumbre asociada a un campo de probabilidades finito, inspirada en el modelo de entropía termodinámica de Boltzmann (1894). Fue él mismo quien dio las nociones de fuente, canal, perturbación, etc., así como algunos de los teoremas fundamentales de la codificación que son la base de esta teoría de la información que nos disponemos a estudiar.

1953, B. McMillan reemprendió los trabajos de Shannon e introduce las definiciones matemáticas de fuente de información y canal de transmisión. Pasa de las fuentes de Markov a las fuentes ergodinámicas (existencia del vector de probabilidades de estado estacionarias).

1954, A. Feinstein dio la primera demostración completa del teorema de codificación, enunciado por Shannon para los canales sin memoria.

1956, A.L Khintchine elaboró el primer tratamiento matemático riguroso y completo de la teoría de la información para los canales estacionarios ergódicos y para los canales con memoria finita y sin anticipación.

1962, M.L. Minsky desarrolló las ideas de R.J.Solomonoff sobre la teoría algoítmico de la información basada en la complejidad asociada a la realización de un cierto algoritmo, por medio de una cierta máquina de Miring. Posterior-, mente, esta teoría se ha ido desarrollando por otros autores como A.N.KoImogorov, P.Martin-L5f y G.J.Chaitin.

1963, S. Winograd y J.D. Cowan publicaron un buen trabajo sobre la teoría de autómatas fiables, construidos a partir de partes no fiables, estableciendo una conexión entre la teoría de la comunicación de Shannon y la de autómatas, desarrollada anteriormente por Von Neumann.

Durante los ańos sesenta del siglo pasado se lleva a cabo una revisión de la teoría de la información de Shannon para contemplar aspectos semánticos de la información. Tales revisiones son los trabajos de Rényi, Forte, Kampé de Fériet, Aczel, etc..

Resumen

Resumiendo lo visto hasta ahora, la función

H de Shannon es una definición de la medida de la información

aportada por un acontecimiento, siendo tomada esta palabra en su sentido

más amplio. Si se acepta que es de la incertidumbre levantada por

la realización de un acontecimiento, la función H tiene todas

las propiedades que parecen razonables a partir de tal definición.

Por otra parte, tiene una propiedad esencial: si un mensaje x está

escrito en un alfabeto de N símbolos xi y se transcribe a un lenguaje

binario, el número medio de símbolos binarios por símbolo

del alfabeto de origen, es al menos H(x). Esta función constituye

el límite a la eficacia de la codificación de un mensaje

cualquiera en representación binaria.

Leon Brillouin, en su libro "La Science

et la Théorie de l´Information" decía: Hemos definido la información como

el resultado de una elección, no la consideramos como el punto de

partida de una previsión, como un resultado que permita hacer otra

elección. Dejamos de lado el valor humano de la información.

Atribuimos un cierto valor de información a un conjunto de 100 letras

sin buscar si este conjunto tiene valor en tiene sentido en lengua inglesa

y si es así, si la frase obtenida tiene algún valor práctico.

Según nuestra definición, daremos el mismo valor de información

a 100 letras tomadas aleatoriamente de un periódico, de una obra

de Shakespeare o de un teorema de Einstein. En otras palabras, nosotros

definimos la información independientemente del conocimiento al

cual no puede atribuir valor numérico.

Nosotros no hacemos distinción entre la información útil y la inútil, prefiriendo ignorar el valor de la información. Nuestra definición estadística de la información se basa en la rareza. Si una situación es rara, contiene información, independientemente de que esta información tenga o no valor. Sin embargo la definición vista de la información es útil para un ingeniero de telecomunicaciones, que debe poder transmitir, por ejemplo, toda la información contenida en un telegrama dado, sin preocuparse del valor que reviste éste para la persona que lo recibe.

Para dar un ejemplo trivial, si se toma una carta de entre las 32 de una baraja, la información es de cinco bit, sea la carta que sea, aunque según el juego que se practique

tendrá distinto significado.

Por otra parte la información se

mide mediante una magnitud positiva, sin embargo en ciertos casos debería

de ser negativa. Supongamos que en una conferencia el que la dicta ha tenido

un error y se da cuenta al final. Por ejemplo, termina diciendo, escúsenme,

todo lo que acabo de decir es falso. Esta frase tiene un valor negativo

y destruye todo el valor de la información precedente.

![]()